中國裁軍大使:中方反對用人工智能武器發(fā)動戰(zhàn)爭(2)

該文件聚焦人工智能軍事應用涉及的研發(fā)、部署,、使用等重要環(huán)節(jié),,就如何在軍事領(lǐng)域負責任地開發(fā)和利用人工智能技術(shù)提出解決思路:

一,、各國在發(fā)展人工智能武器系統(tǒng)方面應保持克制,,人工智能的軍事應用不應成為發(fā)動戰(zhàn)爭和謀求霸權(quán)的工具,,反對利用人工智能技術(shù)謀求絕對軍事優(yōu)勢,,損害他國主權(quán)和領(lǐng)土安全,。

二,、堅持以人為本、智能向善原則,,確保人工智能軍事應用符合國際人道主義法,避免相關(guān)武器系統(tǒng)造成濫殺濫傷和誤用惡用,。

三,、要不斷提升人工智能技術(shù)的安全性、可靠性,、可控性,,增強人工智能安全評估和管控能力,確保人工智能武器永遠處于人類控制之下,。

四,、要對人工智能軍事應用加強監(jiān)管,降低擴散風險,。

五,、要堅持多邊主義、開放包容原則,,共同探討人工智能軍事應用問題的解決之道,,建立普遍參與的國際機制,形成具有廣泛共識的人工智能治理框架和標準規(guī)范,。

六,、加強國際合作,幫助發(fā)展中國家提升治理水平,,確保各國充分享有技術(shù)發(fā)展與和平利用的權(quán)利,。

李松還在發(fā)言中介紹了中方全面參與公約框架下各項議題工作,特別是致力于國際人道主義掃雷援助與合作的情況,。

在為期5天的會議期間,,締約國將全面審議公約過去5年的執(zhí)行情況,同時就公約框架下的新興議題進行討論,,并探討相關(guān)舉措,。

《特定常規(guī)武器公約》的全稱是《禁止或限制使用某些可被認為具有過分傷害力或濫殺濫傷作用的常規(guī)武器公約》。該條約于1981年開放簽署,,并于1983年12月生效,。中國于1981年簽署了這一條約。目前共有125個締約國,。

推薦閱讀

港府總部收到刀片恐嚇信 特首辦嚴正譴責

環(huán)球網(wǎng)2021-12-13 19:46:02

香港小學播南京大屠殺紀錄片被投訴 教育局回應

觀察者網(wǎng)2021-12-13 19:18:31

候補中央委員蔡松濤,任新職

長安街知事2021-12-13 19:12:54

土耳其稱擊斃3名庫爾德武裝分子

央視網(wǎng)2021-12-13 15:23:49

回訪黑龍江密山虎口救人者:剪去留了八年小辮 立志多做好事

新京報2021-12-13 18:13:00

日學者在中國國家公祭日揭批日政府 不僅篡改歷史

海外網(wǎng)2021-12-13 16:54:14

柬埔寨首相:清除殘留的美國武器 用它們老打敗仗

環(huán)球網(wǎng)2021-12-13 11:30:45

德國海軍護衛(wèi)艦將與日本海上自衛(wèi)隊聯(lián)訓

參考消息2021-12-13 13:58:42

北京地鐵14號線即將全線貫通,,麗澤商務(wù)區(qū)站未來可“五線換乘”

新京報2021-12-13 18:41:22

臺媒文章:臺在“外交拉鋸戰(zhàn)”中頻遭打臉

參考消息2021-12-13 15:27:18

拜登稱派部隊進駐烏克蘭的計劃“從未擺在桌面上”

環(huán)球網(wǎng)2021-12-13 15:44:05

視頻|老年玩具店有了新招牌

新京報2021-12-13 19:32:00

國際丨監(jiān)控:紐約亞裔女子在地鐵站遭襲 被黑人打到躲垃圾桶后

新京報2021-12-13 19:22:00

河南死刑犯出獄再對七名幼女多次奸淫 獲死刑

河南省高級人民法院2021-12-13 18:43:27

生活不易!紹興確診的哥曾多天連續(xù)工作20小時 網(wǎng)友破防了

新京報2021-12-13 19:41:07

浙江一女子國家公祭日穿和服逛街,!網(wǎng)友:我不能替先輩原諒

北京青年報2021-12-13 18:12:43

美國強行輸出美式“民主”貽害無窮

新華網(wǎng)2021-12-13 13:50:05

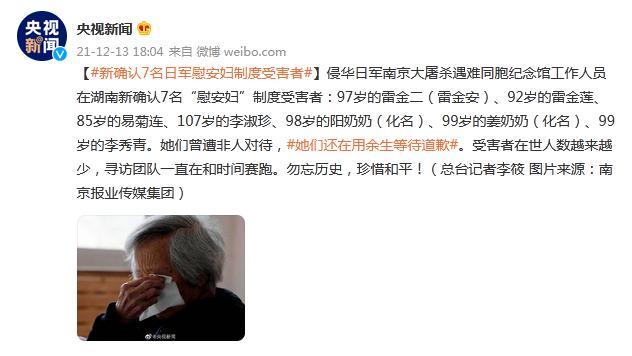

新確認7名日軍慰安婦制度受害者 她們何時能等來道歉,?

新京報2021-12-13 18:37:52

有人要在臺北美國學校開槍?刑警持沖鋒槍守校門口

環(huán)球網(wǎng)2021-12-13 15:14:25

北京冬奧會紀念鈔14日晚開始網(wǎng)上預約 高清精美圖案欣賞

新京報2021-12-13 18:02:00

臺當局代表參加"民主峰會"小動作惹怒白宮畫面被掐

環(huán)球網(wǎng)2021-12-13 15:11:17

與病毒“賽跑”,,清華教授揭秘中國首個新冠特效藥研發(fā)幕后

新京報2021-12-13 17:41:15

對付中俄,?五角大樓籌建人工智能新部門

參考消息2021-12-13 14:12:18

美軍偵察機現(xiàn)身烏克蘭上空,或與俄軍最新動向有關(guān)

環(huán)球網(wǎng)2021-12-13 13:38:44

莎士比亞作品背后的女編輯們浮出歷史地表

新京報2021-12-13 19:41:05

國際丨馬克龍公布個人財務(wù)狀況:近5年收入上百萬歐元

新京報2021-12-13 19:32:00

普京自曝曾開私家車賺錢:說起這事并“不愉快”

參考消息2021-12-13 14:02:25

“??漳繕司纱輾А?俄測試用防空導彈打軍艦

參考消息2021-12-13 14:09:54

女模發(fā)現(xiàn)陌生女相冊有自己睡房照 對方系丈夫情人

2017-11-30 14:32:06

視頻│北京這個地方幾乎每晚都在下雪

新京報2021-12-13 19:32:00

美軍偵察機現(xiàn)身烏克蘭上空 或與俄軍最新動向有關(guān)

環(huán)球網(wǎng)2021-12-13 15:19:08

唐鳳發(fā)言視頻被掐,,大趨勢的小信號

環(huán)球時報2021-12-13 16:30:32

東北虎“完達山1號”放歸后:表現(xiàn)正常 總擴散路程已超千余公里

新京報2021-12-13 19:22:00

廣東江門一木船被大貨船攔腰推頂前行后沉沒 旁觀者大叫:跳水啊

新京報2021-12-13 17:32:00

土耳其無人機首配激光武器成功摧毀目標

參考消息2021-12-13 15:13:05