AI換臉能以假亂真,?這幾種圖片不要隨便發(fā)

原標題:只需一張照片AI換臉就能以假亂真,?這幾種圖片不要隨便發(fā)

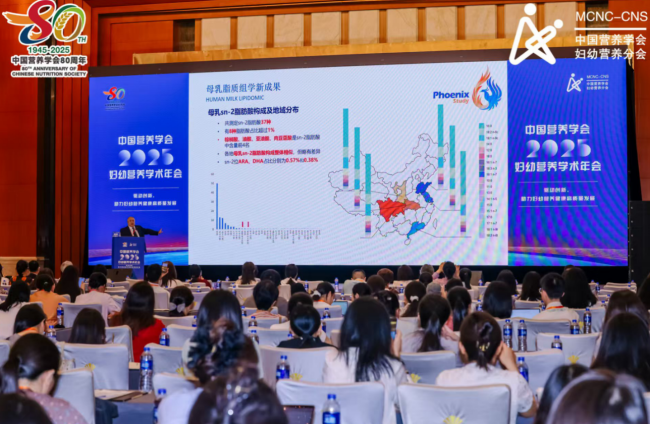

隨著人工智能技術的快速發(fā)展,相關的應用正在進入我們生活的方方面面,。然而,,這也給個人信息保護帶來了新的挑戰(zhàn)。在8日開幕的2024年國家網(wǎng)絡安全宣傳周上,,關于AI換臉,、換聲等對個人隱私侵害的話題成為大家關注的焦點。

一張“人像照片”,、一段近距離的人物視頻,,都有可能成為不法分子犯罪的新手段和新工具。

在今年的網(wǎng)絡安全博覽會上,,各大安全企業(yè)紛紛展示了安全領域新產(chǎn)品和新技術,,尤其是針對人工智能的安全防護更是成為各大安全企業(yè)著力的重點領域。

畫面中技術人員正在演示的就是“AI換臉”技術,,僅需一張目標人物的靜態(tài)照片,,就能讓照片中的人物動起來。

中國網(wǎng)絡空間安全協(xié)會人工智能安全治理專業(yè)委員會委員張博:本身是一張不會動的靜態(tài)圖片,,演示者做一些動作之后,,AI換臉軟件采集到了演示者面部動起來的特征,,把特征融合到靜態(tài)圖片當中,,就讓圖片照著演示者的動作動了起來,也可以形成一個視頻,。

張博介紹,,盡管現(xiàn)在AI換臉、換聲等有一定的技術門檻和操作成本,,但如果被不法分子獲取的情況下,,就有可能被用來假冒他人,實施相關的犯罪活動,。

中國網(wǎng)絡空間安全協(xié)會人工智能安全治理專業(yè)委員會委員張博:當前AI換臉技術還是比較成熟,,能支持視頻通話實時換臉,可以達到以假亂真的程度,。除了換臉之外,,再結(jié)合著換背景環(huán)境、換聲音等,,逼真度就會更高,,更加難以分辨。

推薦閱讀

暑假去哪兒玩,?體驗一下“去建設火星!”

央視新聞客戶端2025-07-21 08:42:14

網(wǎng)友:我的外賣,可能是未來戰(zhàn)機飛行員送的,!

央視軍事2025-07-20 15:27:18

警惕!這些沒有“出生證明”的玩具暗藏風險

央視新聞客戶端2025-07-20 14:59:47

小學生課上被燒傷 百萬治療費誰負責 校方承諾與現(xiàn)實差距

環(huán)球網(wǎng)2025-07-21 15:19:08

朝陽國資房單價5.4萬,值不值得連夜排號,? 塵封13年新房入市

金融界2025-07-21 15:25:48

巴基斯坦“梟龍”戰(zhàn)機斬獲大獎 展示卓越飛行技術

火線前沿2025-07-21 14:41:49

香奈兒否認自己是扁平足,脫鞋自證引發(fā)全場爆笑

微博2025-07-21 15:07:57

特朗普簽署《天才法案》 穩(wěn)定幣監(jiān)管框架確立

光明網(wǎng)2025-07-21 15:11:58

新一輪臺風周三起影響我國 夏季天氣主角登場

北晚在線2025-07-21 15:08:26

北約揚言“拿下”加里寧格勒 逼近俄羅斯核心利益區(qū)

頭條2025-07-21 14:25:51

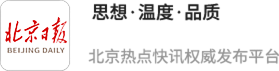

快船官方曬海報迎接比爾加盟 保羅點贊歡迎

鳳凰網(wǎng)2025-07-21 15:12:43

印度反對黨領袖呼吁變革 推動基層變革

觀察者網(wǎng)2025-07-21 14:16:35

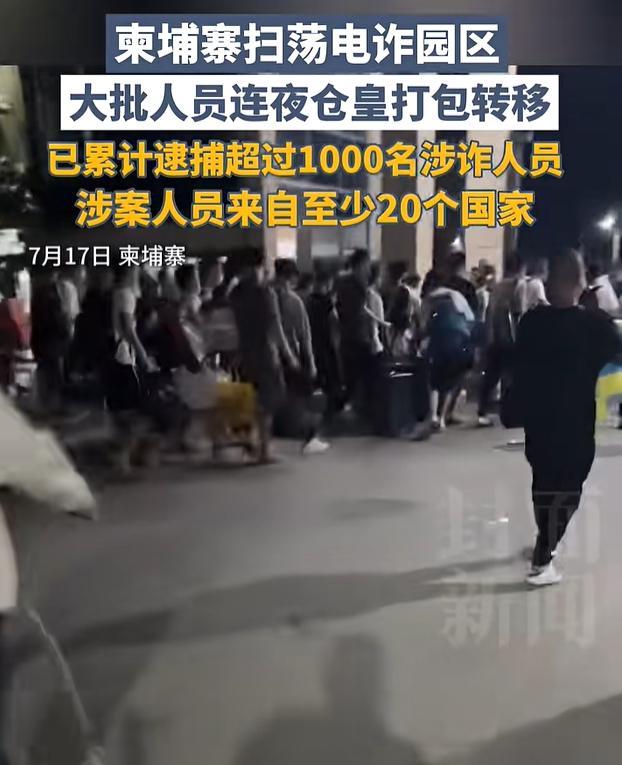

柬埔寨突擊檢查詐騙窩點 逮捕2270名嫌疑人

每日經(jīng)濟新聞2025-07-21 15:17:23

女方不喊老公男子希望退回彩禮 婚姻破裂引爭議

極目新聞2025-07-21 15:07:22

專家:中國或成杜特爾特翻盤關鍵

頭條2025-07-21 14:39:44

石破茂表示繼續(xù)擔任首相 確保政治運作不陷入停滯

中國新聞網(wǎng)2025-07-21 15:11:27

專家:柬方借與泰邊境糾紛強化軍力 政治棋局背后

包明說2025-07-21 14:15:12

快船總裁:考慮簽克里斯保羅 強烈意向浮出水面

北青網(wǎng)2025-07-21 15:17:12

女孩囤積大量吧唧深夜中毒緊急送醫(yī) 二次元收藏引發(fā)健康隱患

手機光明網(wǎng)2025-07-21 15:19:34

男子嫌妻子開車慢 當街打斷其肋骨 家暴行為被判刑

魯網(wǎng)2025-07-21 15:04:30

家里“吧唧”太多 女孩深夜中毒送醫(yī) 二次元收藏需謹慎

極目新聞2025-07-21 15:06:52

當?shù)鼗貞钲诃h(huán)衛(wèi)工臺風天清理樹枝 職責所在安全搶險

騰訊網(wǎng)2025-07-21 15:04:02

熱死的不止蚊子,!全球41%兩棲動物拉響滅絕警報 極端氣候加劇瀕危趨勢

騰訊2025-07-21 15:13:09

美國洛杉磯一車輛沖撞人群 至少28人受傷

央視新聞2025-07-21 15:17:49

加沙有數(shù)百人爭著要殘羹剩飯 只為給家人換來一口食物

頭條2025-07-21 15:07:34

美國新型狼群系列廉價導彈靠譜嗎?直升機打052D,?,?

頭條2025-07-21 14:47:12

柯文哲妻子首次表態(tài)反罷免 支持反惡罷

海峽導報2025-07-21 14:41:30

農(nóng)村新公廁為何成擺設 建而不用引質(zhì)疑

百家號2025-07-21 15:20:55

快船總裁:哈登親自招募比爾 幕后故事揭曉

直播吧2025-07-21 15:26:14

美國為啥死磕伊朗核問題 雙重標準下的地緣政治博弈

搜狐軍事2025-07-21 14:37:28

印度兩兄弟與同一女子結(jié)婚現(xiàn)場畫面 遵循部落傳統(tǒng)的婚禮

極目新聞2025-07-21 15:06:21

李在明止步中國行,,沒等到美國的表揚,反遭到朝鮮無預警“水攻” 韓國尷尬應對

www.163.com2025-07-21 15:15:37

巴基斯坦梟龍戰(zhàn)機斬獲大獎,斬獲雙獎,!

頭條2025-07-21 14:42:38

在建世界第一高橋通車倒計時 橋旅融合新典范

新浪2025-07-21 15:10:57

以色列總理食物中毒 貪腐案聽證會延期至9月

光明網(wǎng)2025-07-21 15:13:25