Meta CEO扎克伯格最新采訪:最強(qiáng)開源模型Llama 3憑什么值百億美金

Meta公司近日震撼發(fā)布開源大語言模型Meta Llama 3,此舉被視為人工智能發(fā)展歷程中的重要里程碑。Llama 3首批推出兩款版本,分別擁有80億參數(shù)(Llama 3 8B)和700億參數(shù)(Llama 3 70B),。更強(qiáng)大的4000億參數(shù)版本(Llama 3 400B)正在緊鑼密鼓地訓(xùn)練中,,預(yù)計(jì)未來數(shù)月內(nèi)將與公眾見面,。

相較于前代Llama 2,,Llama 3不僅在性能上實(shí)現(xiàn)顯著提升,,更在推理,、代碼生成和指令遵循等領(lǐng)域取得突破性進(jìn)展,,使其成為當(dāng)前最頂尖的開源大語言模型。Llama 3的優(yōu)勢(shì)體現(xiàn)在其龐大的參數(shù)規(guī)模,、高質(zhì)量的訓(xùn)練數(shù)據(jù),、先進(jìn)的模型架構(gòu)、創(chuàng)新的微調(diào)技術(shù)及對(duì)安全性的嚴(yán)格把控,,這些因素共同鑄就了其卓越的性能表現(xiàn),,并預(yù)示著未來有望繼續(xù)挑戰(zhàn)行業(yè)標(biāo)準(zhǔn)。

Llama 3的發(fā)布在業(yè)內(nèi)引發(fā)強(qiáng)烈反響,,眾多專家與開發(fā)者紛紛給予高度評(píng)價(jià),。Jim Fan博士視即將面世的Llama 3-400B+模型為社區(qū)獲取GPT-4級(jí)別模型的關(guān)鍵節(jié)點(diǎn),預(yù)期其將重塑諸多研究項(xiàng)目和初創(chuàng)企業(yè)的前進(jìn)路徑,。Cameron R. Wolfe博士則強(qiáng)調(diào)了Llama 3在數(shù)據(jù)質(zhì)量方面的不懈努力,,如采用15萬億個(gè)token的預(yù)訓(xùn)練數(shù)據(jù)(較Llama 2增加7倍,,遠(yuǎn)超DBRX的12萬億個(gè))、豐富代碼數(shù)據(jù),、擴(kuò)大詞匯表至128K tokens以提升效率與性能,,以及實(shí)施全方位數(shù)據(jù)質(zhì)量過濾與實(shí)證分析,確保模型在各種任務(wù)上的出色表現(xiàn),。

Aston Zhang作為Llama 3的開發(fā)者,,分享了研發(fā)過程中面臨的挑戰(zhàn)與寶貴經(jīng)驗(yàn),揭示了數(shù)據(jù),、計(jì)算,、基礎(chǔ)設(shè)施、模型,、推理,、安全和評(píng)估等環(huán)節(jié)的緊密協(xié)作。他透露,,最大模型已超過400B參數(shù)且仍在訓(xùn)練,,選擇8B而非7B模型的原因在于升級(jí)tokenizer至128K詞匯表以提高效率與性能。此外,,Llama 3預(yù)訓(xùn)練上下文窗口設(shè)為8K tokens,,未來將發(fā)布支持更長上下文窗口的模型,并輔以自動(dòng)評(píng)估與精心設(shè)計(jì)的人工評(píng)估,,以全面衡量模型性能,。

相關(guān)新聞

阿里云發(fā)布開源模型Qwen2,宣稱性能超美國最強(qiáng)開源模型Llama3-70B

6月7日,,阿里云在技術(shù)博客上宣布了一個(gè)重要進(jìn)展:他們發(fā)布了名為Qwen2-72B的開源模型,,這款模型在全球范圍內(nèi)以其卓越的性能脫穎而出

2024-06-07 10:49:47阿里云發(fā)布開源模型Qwen2一夜暴漲2000億美元,,扎克伯格力壓比爾蓋茨,Meta出了口惡氣

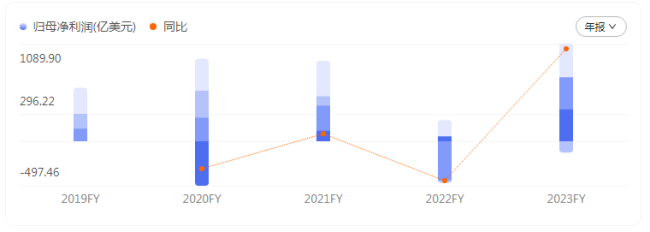

不瘋魔,,不成活,!當(dāng)巨虧500億美元的扎克伯格仍無緣無悔選擇頭撞南墻之際,有誰能想到,,有朝一日,,他會(huì)讓墜落谷底的Meta創(chuàng)造“絕地逢生”的奇跡?01

2024-02-04 22:33:33一夜暴漲2000億美元斯坦福AI團(tuán)隊(duì)承諾撤下相關(guān)模型 因抄襲國內(nèi)開源模型致歉

2024-06-04 15:37:44斯坦福AI團(tuán)隊(duì)承諾撤下相關(guān)模型扎克伯格身家超過馬斯克,成為世界第三富有的人

扎克伯格身家超過馬斯克媒體報(bào)道稱,,扎克伯格目前以1870億美元(約合人民幣1.35萬億元)的身價(jià)位列全球富豪榜第三,。這是自2020年以來他首次進(jìn)入前三名。

2024-04-08 10:32:06扎克伯格身家超過馬斯克黃仁勛最新對(duì)話:開源閉源模型會(huì)和諧共存 企業(yè)不利用GenAI遲早被淘汰

2024-06-17 10:00:37黃仁勛最新對(duì)話:開源閉源模型會(huì)和諧共存95后CEO劉光耀官宣結(jié)婚 新娘顏值驚艷,管理百億資產(chǎn)

2024-01-13 13:16:0495后CEO劉光耀官宣結(jié)婚