“AI換臉”騙走2億港元 專家支招如何防范

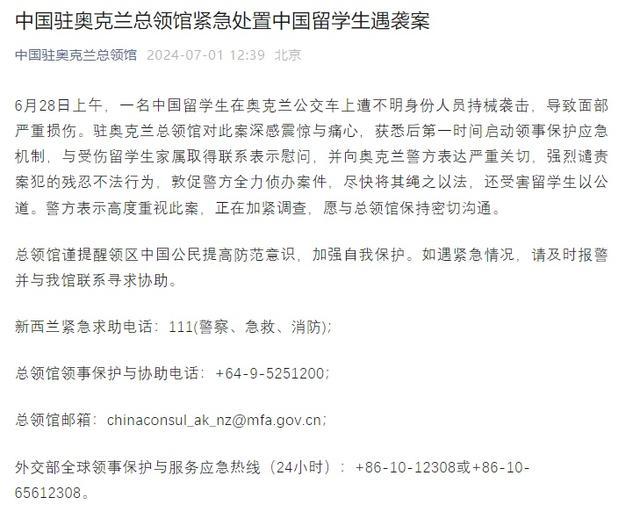

AI已成為過去一年的網(wǎng)絡熱點,,伴隨其廣泛應用,,AI詐騙現(xiàn)象日益引起關注,尤其是運用AI換臉技術實施的詐騙案件屢見報端,。近期,,香港警方通報一起案例:某跨國公司香港分公司財務人員在一場內(nèi)部視頻會議中被騙走近2億港元,,除受害人本人外,,其余“參會同事”均為AI換臉技術偽裝,。類似事件在2023年央視315晚會上亦有曝光,。

Deepfake,即深度偽造技術,,是AI換臉的核心手段,。它基于深度學習算法,通過處理大量視頻和圖像數(shù)據(jù),,創(chuàng)造出高度逼真的面部動畫和語音,。該技術首次進入公眾視野是在2017年,一名Reddit用戶將一部成人電影主角的臉替換為《神奇女俠》演員蓋爾·加朵,,引發(fā)廣泛關注,。此后,Deepfake在中國也頗受歡迎,,網(wǎng)絡上充斥著AI換臉教程,、素材庫及輔助工具,如2019年B站UP主“換臉哥”將朱茵飾演的黃蓉換臉為楊冪,,一度引發(fā)熱議,。

隨著Deepfake技術的開源以及生成式AI如ChatGPT和Sora的普及,AI換臉門檻顯著降低,,制作難以辨識的換臉視頻愈發(fā)容易,。然而,,技術濫用導致的AI詐騙事件頻發(fā),成功率高企,,嚴重侵犯公眾財產(chǎn)與隱私權益,,相關話題多次沖上熱搜榜。

面對“AI變臉”欺詐,,識別真?zhèn)纬蔀闊嶙h焦點,。有專家提出讓對方按壓鼻子或臉部以觀察變形情況,以此判斷是否為真人,。盡管此法有一定參考價值,,但并非萬無一失。螞蟻集團天璣實驗室安全算法專家朱凱指出,,部分先進算法已能在局部遮擋下生成逼真畫面,,單純按壓鼻子或臉部可能無法識破。他建議結(jié)合左右搖頭動作,,因許多AI換臉基于平面照片,,動態(tài)變化下易暴露破綻。此外,,也有專家建議對方在視頻通話中揮手,,或提問只有對方知道的問題,以增加識別準確性,。

面對深度偽造技術的挑戰(zhàn),,業(yè)內(nèi)正積極探索以AI對抗AI的解決方案。百度,、阿里,、騰訊、字節(jié)跳動,、螞蟻集團,、科大訊飛等企業(yè)紛紛研發(fā)高級AI算法與工具,提升對深度偽造內(nèi)容的識別能力,。以螞蟻數(shù)科為例,,其旗下ZOLOZ品牌推出Deeper產(chǎn)品,專用于攔截刷臉過程中的AI換臉風險,,已在身份安全領域?qū)崿F(xiàn)Deepfake風險“0漏過”,。ZOLOZ還設立百萬獎金池,鼓勵安全極客挖掘產(chǎn)品漏洞,,共同提升安全防護水平,。

對于普通用戶而言,除掌握一些識別AI換臉詐騙的技巧外,,更重要的是加強個人信息保護,,特別是圖像,、聲音等生物信息。今年8月起,,《生成式人工智能服務管理暫行辦法》正式實施,,明確禁止侵犯他人肖像權、名譽權,、榮譽權,、隱私權和個人信息權益。中國信通院人工智能研究中心安全與元宇宙部主任石霖建議:選擇信譽良好,、監(jiān)管合規(guī)的大廠產(chǎn)品,;減少在APP中上傳個人照片,尤其是社交平臺,;必要時提供虛假聯(lián)系方式以降低信息泄露風險;在涉及資金交易時,,務必通過多種渠道核實對方身份,,未經(jīng)確認切勿轉(zhuǎn)賬。

相關新聞

一文了解如何防范漲水蛾 專家支招應對方法

2024-05-28 17:11:16一文了解如何防范漲水蛾AI換臉詐騙,,財務被騙轉(zhuǎn)賬186萬元,!怎么防范?專家教你這三招,!

近年來,,隨著人工智能技術的進步,,一些不法分子開始利用AI技術融合他人面孔和聲音,制造非常逼真的合成圖像來實施新型網(wǎng)絡詐騙,,這類騙局常常會在短時間內(nèi)給被害人造成較大損失,。

2024-03-04 13:27:49AI換臉詐騙防范“AI換臉”詐騙 你需要的知識都在這兒了→

近年來,隨著人工智能技術的進步,,一些不法分子開始利用AI技術融合他人面孔和聲音,,制造非常逼真的合成圖像來實施新型網(wǎng)絡詐騙,這類騙局常常會在短時間內(nèi)給被害人造成較大損失,。

2024-02-26 03:29:42AI換臉懷疑對方AI換臉可以讓對方摁鼻子

電信詐騙分子或通過AI換臉,、模擬變聲等,假冒熟人進行詐騙,,中國科技大學網(wǎng)絡空間安全學院執(zhí)行院長俞能海提醒,,可以讓對方摁鼻子、摁臉,,觀察其面部變化,。

2024-03-04 09:18:50懷疑對方AI換臉可以讓對方摁鼻子在白紙上簽字要承擔哪些風險?哪種簽名具有法律效力,? 法律專家支招防范

2024-06-30 19:50:03在白紙上簽字要承擔哪些風險,?哪種簽名具有法律效力,?被騙2億港元!參加多人視頻會議只有自己是真人

參加多人視頻會議結(jié)果只有自己是真人這事聽上去似乎匪夷所思卻真實地發(fā)生了近期,,香港警方披露了一起多人“AI換臉”詐騙案涉案金額高達2億港元在這起案件中

2024-03-01 10:32:24被騙2億港元,!參加多人視頻會議只有自己是真人