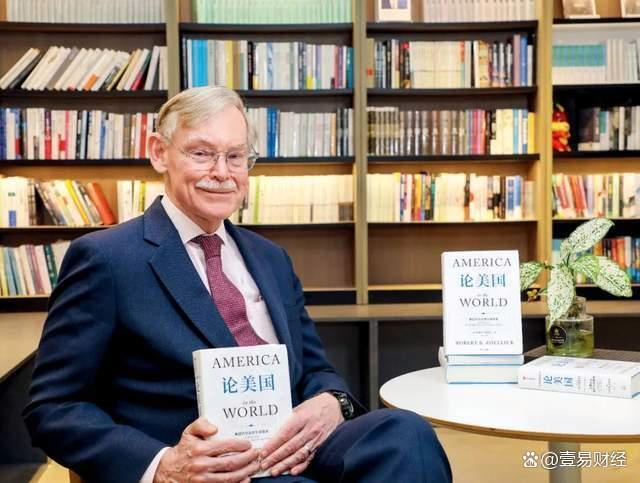

前谷歌CEO反對開展“AI曼哈頓計劃” 倡導(dǎo)防御性策略

在周三發(fā)布的一份政策文件中,,前谷歌首席執(zhí)行官埃里克·施密特,、Scale AI公司首席執(zhí)行官亞歷山大·王以及人工智能安全中心主任丹·亨德里克斯表示,美國不應(yīng)以“曼哈頓計劃”式的方式大力推動開發(fā)具有“超人”智能的人工智能系統(tǒng),,即通用人工智能(AGI),。這份題為《超級智能戰(zhàn)略》的文件認(rèn)為,美國若積極爭取獨家掌控超級智能人工智能系統(tǒng),,可能會招致同行的強(qiáng)烈報復(fù),,報復(fù)形式很可能是網(wǎng)絡(luò)攻擊,這可能會破壞國際關(guān)系的穩(wěn)定,。

文件指出,,“曼哈頓計劃”假定競爭對手會默許一種持久的不平衡狀態(tài)或是全球性毀滅,而不會采取行動去阻止它。一開始旨在研發(fā)超級武器并實現(xiàn)全球控制的行動,,有可能引發(fā)敵對的反制措施,,并加劇緊張局勢,從而破壞這一戰(zhàn)略聲稱要維護(hù)的穩(wěn)定,。這份文件由美國人工智能行業(yè)三位極具影響力的人物共同撰寫,。就在幾個月前,美國國會一個委員會提議開展一項“曼哈頓計劃”式的行動,,為通用人工智能的開發(fā)提供資金,,其模式效仿的是美國在20世紀(jì)40年代的原子彈計劃。美國能源部長克里斯·賴特最近與OpenAI聯(lián)合創(chuàng)始人格雷格·布羅克曼一同站在一個超級計算機(jī)站點前時表示,,美國正處于人工智能領(lǐng)域“新曼哈頓計劃的開端”,。

《超級智能戰(zhàn)略》這份文件對近幾個月來一些美國政策制定者和行業(yè)領(lǐng)袖所倡導(dǎo)的觀點提出了挑戰(zhàn),該觀點認(rèn)為由政府支持的通用人工智能研發(fā)項目是與他國競爭的最佳方式,。在施密特,、王和亨德里克斯看來,美國在通用人工智能領(lǐng)域處于一種類似于相互確保摧毀的對峙狀態(tài),。就像全球大國不會尋求對核武器的壟斷一樣,,施密特及其共同作者認(rèn)為,美國在競相主導(dǎo)極其強(qiáng)大的人工智能系統(tǒng)時應(yīng)持謹(jǐn)慎態(tài)度,。

雖然將人工智能系統(tǒng)比作核武器聽起來有些極端,,但世界各國已將人工智能視為一項重要的軍事優(yōu)勢。美國五角大樓已經(jīng)表示,,人工智能正在幫助加快軍方的“殺傷鏈”速度,。施密特等人提出了一個他們稱之為“相互確保人工智能失靈”(MAIM)的概念,即各國政府可以主動禁用具有威脅性的人工智能項目,,而不是等待對手將通用人工智能武器化,。

施密特、王和亨德里克斯提議,,美國應(yīng)將重點從“在追求超級智能的競賽中獲勝”轉(zhuǎn)移到開發(fā)能阻止其他國家創(chuàng)建超級智能人工智能的方法上,。這些共同作者認(rèn)為,政府應(yīng)該擴(kuò)充其網(wǎng)絡(luò)攻擊手段,,以禁用其他國家控制的具有威脅性的人工智能項目,,同時限制對手獲取先進(jìn)的人工智能芯片和開源模型。這些共同作者指出了在人工智能政策領(lǐng)域存在的一種二分法,。一方面是“悲觀論者”,,他們認(rèn)為人工智能發(fā)展帶來的災(zāi)難性后果已不可避免,并主張各國放緩人工智能的發(fā)展進(jìn)程,。另一方面是“鴕鳥派”,,他們認(rèn)為各國應(yīng)加速人工智能的發(fā)展,,并基本上只是寄希望于一切都會順利解決。

該文件提出了第三條道路:一種以防御策略為優(yōu)先的,、有節(jié)制的通用人工智能開發(fā)方式,。這一策略出自施密特之口尤其引人關(guān)注,因為他此前曾直言美國需要在開發(fā)先進(jìn)人工智能系統(tǒng)方面積極,。特朗普政府似乎堅決要推進(jìn)美國的人工智能發(fā)展,。然而,正如這些共同作者所指出的,,美國在通用人工智能方面的決策并非孤立存在。當(dāng)全世界都在關(guān)注美國挑戰(zhàn)人工智能極限的舉動時,,施密特及其共同作者認(rèn)為,,采取防御性策略可能更為明智。

相關(guān)新聞

谷歌前CEO評DeepSeek 呼吁美國加大開源AI努力

2025-01-29 13:59:20谷歌前CEO評DeepSeek谷歌CEO贊賞DeepSeek,,宣布750億美元AI投資計劃加速布局

2025-02-05 12:14:15谷歌CEO贊賞DeepSeek谷歌CEO談AI的未來 影響漸進(jìn)無縫融入生活

2024-11-12 10:18:14谷歌CEO談AI的未來涉DeepSeek,,谷歌CEO發(fā)聲 科技巨頭點贊AI成就

2025-02-06 10:55:37涉DeepSeek英特爾前CEO力挺DeepSeek AI創(chuàng)新迎來新機(jī)遇

2025-01-29 09:29:35英特爾前CEO力挺DeepSeek美國計劃授權(quán)谷歌作為“守門人” 管制AI芯片出口

[環(huán)球時報駐美國特約記者 馮亞仁]據(jù)路透社12月13日報道,,兩名知情人士透露,美國政府正在計劃授權(quán)谷歌,、微軟等主要云服務(wù)提供商

2024-12-16 09:28:49美國計劃授權(quán)谷歌作為“守門人”