用DeepSeek創(chuàng)收的“小公司”,,痛并快樂著

AI Infra公司在宣布接入DeepSeek-R1后,,會(huì)有很多中小企業(yè)前來聯(lián)系,希望獲得部署了R1模型的產(chǎn)品,,清程極智就遇到了類似情形,。

“你們的DeepSeek是不是‘滿血版’?”清程極智CEO湯雄超曾被客戶這么問,。

注:DeepSeek滿血版即DeepSeek-R1模型的頂級(jí)版本,,模型參數(shù)達(dá)671B(6710億),是普通版(14B/32B)的20倍以上,,滿血版支持本地/API部署及復(fù)雜科研計(jì)算,,能力上限更高,且對(duì)硬件要求也更高,。

收到太多此類問詢后,,清程極智團(tuán)隊(duì)決定用工程解決這個(gè)問題——在官網(wǎng)上線一個(gè)“滿血版”鑒別小程序,并精心挑選了幾道比較有區(qū)分度的題目,,用戶可以用這些題目去提問,如果系統(tǒng)回答得對(duì),,基本上就是“滿血版”,;如果回答不出來,可能就不是“滿血版”,。

該小程序上線后,,其訪問量超出了清程極智的預(yù)期。

實(shí)際上,,清程極智的經(jīng)歷只是近期AI行業(yè)的一個(gè)縮影,。

“整個(gè)AI行業(yè)這一個(gè)多月應(yīng)該都過得很充實(shí)?!庇袠I(yè)內(nèi)人士表示,。DeepSeek的火爆,讓整個(gè)AI賽道的從業(yè)人員處于一種“痛并快樂著”的狀態(tài),。

一方面,,DeepSeek的出現(xiàn)激發(fā)了普通用戶使用AI工具的意識(shí)和需求,,推動(dòng)了AI的普及。DeepSeek也成為有史以來增速最快的AI應(yīng)用,,據(jù)AI產(chǎn)品榜統(tǒng)計(jì),,DeepSeek 2月份活躍用戶1.57億,已接近ChatGPT 7.49億的20%,。過多用戶的涌入,,也讓DeepSeek對(duì)話機(jī)器人常常陷入“服務(wù)器繁忙”的狀態(tài)。

另一方面,,DeepSeek的快速迭代和開源,,讓本來就“卷”的AI行業(yè)進(jìn)入了新一輪的“軍備競(jìng)賽”,從模型層至應(yīng)用層的很多公司,,在今年春節(jié)期間幾乎沒有休息,。眾多企業(yè)宣布接入DeepSeek,既有云服務(wù)提供商,、芯片制造商等B端公司,,也有各類C端應(yīng)用公司。據(jù)正和島統(tǒng)計(jì),,已有超200家企業(yè)完成DeepSeek技術(shù)接口的集成部署,。

接入的企業(yè)也迎來了一波“潑天流量”——騰訊元寶APP在接入DeepSeek之后,下載量迅速攀升,,并在3月3日登頂中國(guó)區(qū)蘋果應(yīng)用商店免費(fèi)APP下載排行榜TOP1,;作為AI基礎(chǔ)設(shè)施公司,硅基流動(dòng)在全網(wǎng)最快接入DeepSeek-R1,,訪問量激增40倍,,2月訪問量高達(dá)1719萬人次。

DeepSeek-R1的出現(xiàn),,也進(jìn)一步提高了各方對(duì)AIGC應(yīng)用加速發(fā)展的期待,。

當(dāng)3月6日Monica.im發(fā)布AI智能體產(chǎn)品Manus時(shí),再次引發(fā)了一場(chǎng)“邀請(qǐng)碼搶購(gòu)”狂潮,。

無論是各大模型廠商還是AI產(chǎn)業(yè)鏈上下游的公司,,都在興奮地等待通往未來AI世界的關(guān)鍵路徑。

如何接入DeepSeek

早在2024年DeepSeek-V2模型發(fā)布時(shí),,業(yè)內(nèi)已經(jīng)關(guān)注到這家公司及旗下的開源模型,。

美圖設(shè)計(jì)室技術(shù)負(fù)責(zé)人郭晨暉表示,為了在美圖的AI應(yīng)用場(chǎng)景中給用戶更好的效果體驗(yàn),,在自研的基礎(chǔ)上,,美圖也一直對(duì)國(guó)內(nèi)外優(yōu)秀的大模型保持關(guān)注。DeepSeek-V2發(fā)布時(shí),美圖的外采AI團(tuán)隊(duì)就關(guān)注到了該模型,,與DeepSeek團(tuán)隊(duì)接觸嘗試合作,。不過為了尋求穩(wěn)定性,美圖當(dāng)時(shí)主要通過第三方AI Infra服務(wù)商調(diào)用DeepSeek模型API,。2024年9月,,美圖設(shè)計(jì)室接入了V2模型,輔助文案擴(kuò)寫,,V3,、R1模型發(fā)布后,他們也陸續(xù)進(jìn)行了更新,?!拔覀儺a(chǎn)品和業(yè)務(wù)團(tuán)隊(duì)看到一些適合結(jié)合的模型,就會(huì)去做效果評(píng)估,,合適的可能就會(huì)引入到我們自己的應(yīng)用場(chǎng)景里,。”郭晨暉說,。

郭晨暉來源:受訪者

DeepSeek官方提供了兩個(gè)接入方法,,一是模型跑起來后,通過一些編程方式去調(diào)用它的API接口,;二是用戶在手機(jī)上裝一個(gè)APP或打開官網(wǎng)的聊天窗口,,直接跟它對(duì)話,聊天窗口的背后就在調(diào)用API,。

不過,,由于目前DeepSeek的流量過高,又存在服務(wù)器,、人手不足等情況,,導(dǎo)致DeepSeek自己的API會(huì)出現(xiàn)超時(shí)等問題。郭晨暉表示,,美圖旗下產(chǎn)品有著大體量的用戶基數(shù),,一些功能推廣開來后流量可能會(huì)激增數(shù)十倍、上百倍,,這種情況下,公有云的服務(wù)保障能力相對(duì)更強(qiáng),。

不僅如此,,DeepSeek的模型比較大,尤其是“滿血版”模型對(duì)硬件有一定要求,;基于性價(jià)比層面的考慮,,美圖的業(yè)務(wù)場(chǎng)景存在很顯著的(使用)高峰、低峰效應(yīng),,云廠商可以抹平各家調(diào)用API高低峰期的差異,?!叭绻覀冏约哼M(jìn)行部署,低峰期資源利用率可能比較低,,會(huì)有比較大的資源浪費(fèi),。”郭晨暉說,。

因此,,美圖目前接入DeepSeek-R1模型的方式,主要是調(diào)用云廠商的API,,在此基礎(chǔ)上進(jìn)行一定的私有化部署,。

與美圖類似,部署端側(cè)芯片的此芯科技,,也一直對(duì)新發(fā)布的各種大模型保持關(guān)注,,尤其是比較適合在端側(cè)進(jìn)行本地化部署的模型。此芯科技生態(tài)戰(zhàn)略總經(jīng)理周杰表示,,對(duì)于一些開源的大模型,,尤其是SOTA模型(State of the Art,在某一領(lǐng)域或任務(wù)中表現(xiàn)最佳的模型),,他們會(huì)第一時(shí)間投入資源進(jìn)行相應(yīng)的異構(gòu)適配,。因此在DeepSeek去年發(fā)布V2以及今年發(fā)布R1后,此芯科技都第一時(shí)間嘗試適配這些模型,。

在周杰看來,,DeepSeek-V2模型的主要?jiǎng)?chuàng)新點(diǎn)有兩個(gè),一是通過MLA(多頭潛在注意力)架構(gòu)有效地降低了KV緩存(Transformer模型在自回歸解碼過程中使用的一種優(yōu)化技術(shù))的開銷,,因?yàn)榇笳Z言模型對(duì)于內(nèi)存帶寬和容量的要求很高,,一旦能夠降低KV緩存,可以給算力平臺(tái)帶來很大幫助,;二是DeepSeek發(fā)布的MoE(混合專家)模型,,對(duì)傳統(tǒng)MoE架構(gòu)進(jìn)行了優(yōu)化改造,這個(gè)架構(gòu)可以讓一個(gè)(參數(shù))更大的模型在資源有限的情況下被使用,。

當(dāng)時(shí),,此芯科技很快適配了V2模型的light版本,即16B大小的模型,?!半m然16B參數(shù)看起來也很大,但實(shí)際運(yùn)行時(shí),,它只會(huì)激活2.4B參數(shù),。我們覺得這樣的模型非常適合在端側(cè)運(yùn)行,此芯科技的P1芯片也可以給2.4B參數(shù)規(guī)模的模型提供比較好的支持?!敝芙芨嬖V《中國(guó)企業(yè)家》,。

周杰來源:受訪者

對(duì)于此芯科技如何“接入”DeepSeek,周杰解釋道:“用戶現(xiàn)在使用DeepSeek等應(yīng)用,,很多需要調(diào)用云端的算力,,相當(dāng)于DeepSeek自己的數(shù)據(jù)中心或云廠商,提供了一些API給終端側(cè)應(yīng)用調(diào)用,,用戶使用DeepSeek APP時(shí),,就可以調(diào)用云端的AI能力。但是部分端側(cè)場(chǎng)景可能對(duì)數(shù)據(jù)隱私等方面有很高的要求,,這種情況下就需要在本地進(jìn)行運(yùn)算,,在端側(cè)部署后,用戶可以在斷網(wǎng)的情況下運(yùn)行DeepSeek等模型,?!?/p>

從算力和系統(tǒng)層面滿足了運(yùn)行一個(gè)大語言模型的基本要求后,此芯科技就可以結(jié)合客戶項(xiàng)目的實(shí)際需求,,跟DeepSeek等模型廠商進(jìn)行商業(yè)化合作,,對(duì)模型進(jìn)行微調(diào)優(yōu)化,把具體項(xiàng)目落地,。

V2推出后,,清程極智內(nèi)部也嘗試接入該模型,但當(dāng)時(shí)的市場(chǎng)需求較少,,他們就沒有推廣使用,。今年R1出來后,他們覺得這是一個(gè)非常好的機(jī)會(huì),,決定接入DeepSeek并大規(guī)模向客戶推廣,。

清程極智是做系統(tǒng)軟件的,對(duì)外基于系統(tǒng)軟件提供推理服務(wù),,因此不是像部分應(yīng)用公司那樣直接接入DeepSeek的API,,而是為客戶提供一套專屬的DeepSeek的API用于應(yīng)用服務(wù)?!拔覀兘尤氲姆绞绞前袲eepSeek的開源模型下載下來,,在我們的算力系統(tǒng)上用系統(tǒng)軟件把服務(wù)部署起來?!睖鄢f,。

通俗來講,R1模型是一個(gè)幾百G大小的文件,,但下載后無法直接使用,。

“它只是一個(gè)文件,不是一個(gè)可用的服務(wù),,我們要做的是把這個(gè)模型運(yùn)行起來,,讓它去對(duì)外提供服務(wù)的接口。通過API的服務(wù)接口,,用戶就可以跟模型進(jìn)行對(duì)話了,。”湯雄超解釋道,。

基于前期技術(shù)積累,,清程極智在把模型文件下載下來后,一天內(nèi)就迭代出了第一個(gè)版本,,隨后針對(duì)R1模型結(jié)構(gòu)進(jìn)行了優(yōu)化,,正式“滿血版”官宣上線只用了一周。

在湯雄超看來,,技術(shù)環(huán)節(jié)的工作都比較順利,,接入DeepSeek后,更多的挑戰(zhàn)來自于商務(wù)側(cè)或市場(chǎng)側(cè),。具體來說,,DeepSeek的流量給公司帶來了非常多來咨詢的客戶,但每個(gè)客戶的需求都不太一樣,?!鞍ㄋ懔ζ脚_(tái)、芯片型號(hào),、服務(wù)器規(guī)格等都不一樣,,我們需要針對(duì)不同的算力等基礎(chǔ),做針對(duì)性的調(diào)優(yōu),?!睖鄢f。

API成本降低推動(dòng)大模型普及

在2024年5月發(fā)布V2模型后,,因其極致性價(jià)比,,DeepSeek獲得“AI界拼多多”的稱號(hào),并帶動(dòng)國(guó)內(nèi)大廠打起了大模型價(jià)格戰(zhàn),。

價(jià)格戰(zhàn)降低了API費(fèi)用,。以美圖“AI商品圖”為例,在郭晨暉看來,,一方面,,美圖在AI圖像處理上擁有強(qiáng)大技術(shù)優(yōu)勢(shì),而DeepSeek模型的接入帶來了用戶體驗(yàn)和轉(zhuǎn)化的正向反饋,,且大語言模型API的調(diào)用成本占比很低,,這與美圖的業(yè)務(wù)場(chǎng)景形成了很好的優(yōu)勢(shì)互補(bǔ),,因此美圖也會(huì)加大對(duì)大語言模型應(yīng)用的關(guān)注。

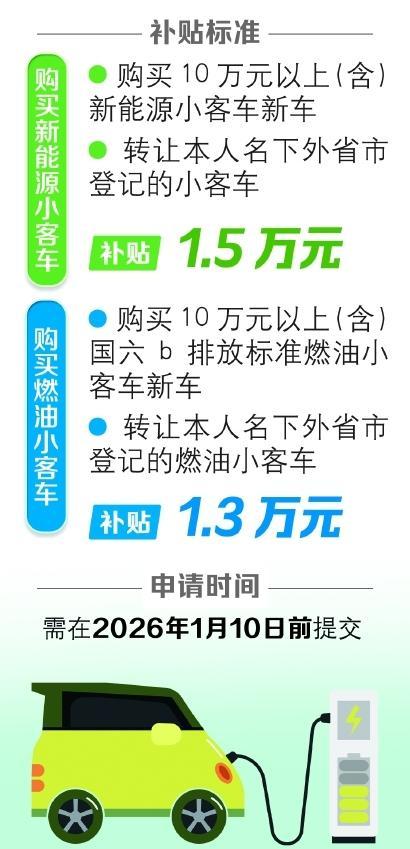

2月9日,,DeepSeek停止了V3模型為期45天的優(yōu)惠價(jià)格體驗(yàn)期,,API恢復(fù)原價(jià),每百萬輸入tokens 0.5元(緩存命中)/2元(緩存未命中),,每百萬輸出tokens 8元,。R1的百萬tokens輸入價(jià)格(緩存命中)為1元,百萬tokens輸入價(jià)格(緩存未命中)為4元,,輸出價(jià)格為16元,。

但OpenAI官網(wǎng)顯示,GPT-4o的2.5美元/百萬輸入tokens,,10美元/百萬輸出tokens,;最新發(fā)布的GPT-4.5的百萬輸入/輸出tokens更是高達(dá)75美元/150美元,僅較GPT-4o就上漲了15~30倍,。

在郭晨暉看來,,一方面DeepSeek模型調(diào)用費(fèi)用在美圖AI研投的整體成本占比不高;另一方面,,DeepSeek恢復(fù)原價(jià)后依然處于比較便宜的價(jià)格區(qū)間,,且美圖接入DeepSeek后,在用戶轉(zhuǎn)化及反饋上是正向的,,因此他們會(huì)加大在大語言模型方面的投入,。

周杰也認(rèn)為,DeepSeek的API價(jià)格比OpenAI低了很多倍,,對(duì)于企業(yè)和用戶而言,,買token的費(fèi)用大大降低。在端側(cè)模型層面,,現(xiàn)在一個(gè)3B的模型可能就能做到以前7B以上規(guī)模的模型效果,,內(nèi)存等成本也相對(duì)降低了。

“這是個(gè)軟硬件協(xié)同的過程,。同樣的硬件條件下,,現(xiàn)在相當(dāng)于能實(shí)現(xiàn)以前更大參數(shù)規(guī)模的模型效果,或者要達(dá)到同樣的模型效果,,對(duì)硬件的要求變低了,。”周杰說,。

3月初,,持續(xù)五天的“DeepSeek開源周”結(jié)束后,DeepSeek團(tuán)隊(duì)首次對(duì)外公布了模型的優(yōu)化技術(shù)細(xì)節(jié),、成本利潤(rùn)率等關(guān)鍵信息,。按DeepSeek測(cè)算,,其成本利潤(rùn)率理論上能達(dá)到545%。

大模型成本的快速降低以及能力的提升,,也帶來了to B和to C領(lǐng)域用戶的高速增長(zhǎng),。

湯雄超透露,現(xiàn)在有很多的中小企業(yè)會(huì)主動(dòng)聯(lián)系到他們,,希望獲得基于R1模型的產(chǎn)品。

AI應(yīng)用將加速爆發(fā)

百度創(chuàng)始人,、董事長(zhǎng)兼CEO李彥宏在《緊抓AI智能體爆發(fā)元年機(jī)遇,,推動(dòng)新質(zhì)生產(chǎn)力加快發(fā)展》一文中寫道,大模型的推理成本,,每12個(gè)月就降低90%以上,,遠(yuǎn)超“摩爾定律”。隨著大模型技術(shù)的迭代和成本的直線下降,,人工智能應(yīng)用將大爆發(fā),。

目前,AI市場(chǎng)處于高速增長(zhǎng)階段,,湯雄超認(rèn)為,,DeepSeek的理論利潤(rùn)率高達(dá)545%,對(duì)于整個(gè)行業(yè)的意義和影響非常積極,,給市場(chǎng)科普了算力系統(tǒng)軟件的重要性,。

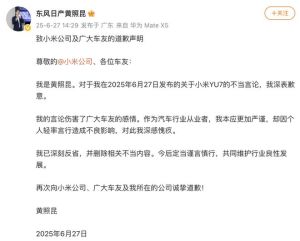

湯雄超來源:受訪者

“過去大家并不是非常重視軟件的能力,DeepSeek讓大家認(rèn)識(shí)到,,花錢買軟件不是浪費(fèi)錢,,而是為了更好地省錢?!睖鄢硎?,在受過教育的市場(chǎng)環(huán)境下,核心系統(tǒng)軟件的優(yōu)勢(shì)能被更大地發(fā)揮出來,;短期來看,,DeepSeek的開源也能讓各方降低產(chǎn)品交付的商業(yè)成本。

隨著越來越多企業(yè)接入DeepSeek,,在其開源生態(tài)上做“建設(shè)”反饋,,DeepSeek的發(fā)展進(jìn)程也在加速。

郭晨暉認(rèn)為,,這也是DeepSeek的開源生態(tài)最大的優(yōu)勢(shì)——接入的企業(yè)在各自應(yīng)用場(chǎng)景上打造差異化能力產(chǎn)品的同時(shí),,應(yīng)用場(chǎng)景也能推動(dòng)DeepSeek等基座大模型的發(fā)展?!案骷夜驹陂_源生態(tài)的差異化部署不僅能加速AI的創(chuàng)新,,大模型的低成本化也有助于大模型在垂直細(xì)分領(lǐng)域的可用性,,給AI的應(yīng)用帶來更大的想象空間?!惫繒熣f,。

在周杰看來,除了云端應(yīng)用爆發(fā)外,,在DeepSeek的推動(dòng)下,,端側(cè)AI應(yīng)用也會(huì)在2025年實(shí)現(xiàn)井噴式發(fā)展。

“未來的AI其實(shí)是一個(gè)混合式的人工智能,,不是所有的東西都在云端跑,,也不是所有東西都在端側(cè)跑,因?yàn)楦饔懈鞯膬?yōu)勢(shì),。如端側(cè)只能跑相對(duì)小規(guī)模參數(shù)的模型,,但對(duì)于某些任務(wù)來說,對(duì)精度有更高要求,,還是要用云端算力,;而為了保證數(shù)據(jù)安全和隱私,就需要使用端側(cè)能力實(shí)現(xiàn)以前更大參數(shù)規(guī)模的模型效果,,這就形成一個(gè)混合式的部署方案,。”周杰說,,此芯科技也在跟云廠商進(jìn)行這方面的應(yīng)用探索,。

“AI應(yīng)用元年”已經(jīng)不是一個(gè)新概念,但截至目前,,AI行業(yè)從業(yè)者以及投資人,,還在尋找更適合AI應(yīng)用的落地場(chǎng)景。在周杰看來,,這只是時(shí)間問題,,“一個(gè)新生態(tài)的發(fā)展肯定需要一定時(shí)間,所有的東西不會(huì)突然完善,,需要軟件和硬件不斷迭代,。目前來看,芯片側(cè),、模型側(cè)等已經(jīng)為AI的大規(guī)模應(yīng)用打下了堅(jiān)實(shí)的基礎(chǔ),,后面需要更多的開發(fā)者來開發(fā)AI應(yīng)用,滿足實(shí)際的場(chǎng)景需求,?!?/p>

相關(guān)新聞

被逼瘋的理工男高管痛并快樂著 從幕后到臺(tái)前的轉(zhuǎn)變

2025-03-23 18:06:06被逼瘋的理工男高管痛并快樂著《向陽(yáng)花》趙麗穎說演高月香痛并快樂著

2025-04-03 15:19:46趙麗穎說演高月香痛并快樂著用deepseek寫的歌在網(wǎng)易云火了

2025-02-14 15:54:13用deepseek寫的歌在網(wǎng)易云火了男子稱用DeepSeek買雙色球中獎(jiǎng)

2025-02-11 15:40:20男子稱用DeepSeek買雙色球中獎(jiǎng)用DeepSeek買彩票聰明反被聰明誤 警惕AI預(yù)測(cè)騙局

對(duì)公眾而言,,需理性看待AI技術(shù),不要盲目相信所謂的“AI預(yù)測(cè)彩票”,。在科技日新月異的今天,,AI似乎成了無所不能的“神器”

2025-02-14 09:10:09用DeepSeek買彩票聰明反被聰明誤年輕人熱衷于用deepseek算命 AI玄學(xué)成新寵

2025-02-14 07:56:48年輕人熱衷于用deepseek算命