哈佛教授:別讓AI只為有錢人服務,富人越來越傲慢!(9)

因此,,我們需要在場,,并主導決策,。無論是在司法,、大學招生,,還是人事招聘系統(tǒng)中,,都需要人類的判斷來理清數據中的偏見,,并嘗試做得更好。

作為人類,,我們肩負著做出道德判斷的責任,因為這件事只有人類才能做,。

Q:我們應該對AI使用設置怎樣的道德邊界,?哪些部分AI可以介入,哪些地方必須明確限制,?

A

:我們應該對AI的使用施加兩種限制,。

第一,我們不能陷入“算法是價值中立的機器,,可以絕對客觀地做出決定”的假設,。我們不能將人類的道德判斷“外包”給AI,。

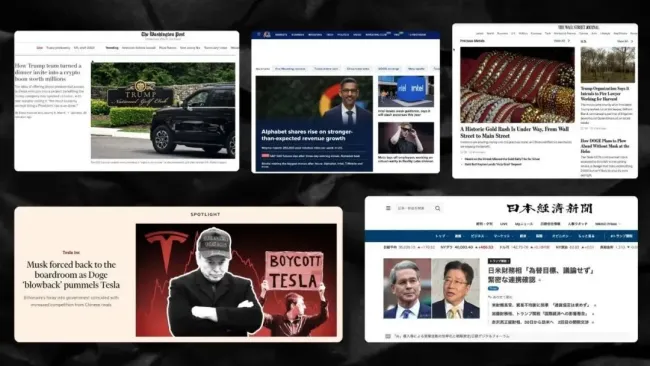

第二,我們應該認識到,科技發(fā)展的方向,,并非本來如此,而是由硅谷和其他地方的風險投資人為了自己的利益刻意引導的,。

因此,,我們需要進行公開討論,引導這些強大新工具的開發(fā)目的,。比如,如何讓它們促進人類的工作,,讓工人更具生產力,享受更高的工資,,而不是試圖將一切自動化,,用AI取代工人,。技術的發(fā)展方向,,應該為所有人一起深思熟慮過的公共利益服務,。

Q:在人們對AI的所有擔憂中,您認為最關鍵的問題是什么,?

A

:機器人會取代我們的工作嗎,?大數據時代是否意味著我們不再有隱私?Deepfake這樣的工具和虛假信息的傳播會導致社會分化更加嚴重嗎,?這些都是重要的隱患。

關閉

相關新聞

哈佛與白宮對決 美國人如何站隊

2025-04-21 08:56:45哈佛與白宮對決哈佛大學教授:對中美關系仍保持樂觀 盡管面臨不確定性

2025-03-25 12:52:09哈佛大學教授哈佛大學教授團體起訴美國政府 捍衛(wèi)學術自由

2025-04-13 17:41:56哈佛大學教授團體起訴美國政府施壓升級,!特朗普政府要求哈佛提供過去十年有關外國資金和關系記錄 哈佛反擊免稅威脅

2025-04-19 15:20:05施壓升級全球文科倒閉潮來了 哈佛風波引發(fā)熱議

2024-12-28 21:17:30全球文科倒閉潮來了哈佛大學教授團體起訴美政府 捍衛(wèi)學術自由

2025-04-13 20:15:41哈佛大學教授團體起訴美政府