DeepSeekR2都有哪些爆料 參數(shù)與硬件升級

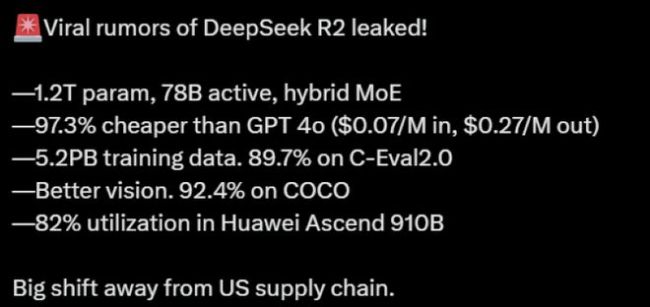

昨晚,,玩家deedydas在社交媒體上披露了深度求索即將發(fā)布的下一代AI大模型DeepSeek-R2的參數(shù)信息。DeepSeek-R2將采用更先進的混合專家模型(MoE),,結合智能門控網(wǎng)絡層,,以優(yōu)化高負載推理任務的性能。新模型的總參數(shù)量預計將達到1.2萬億,,是DeepSeek-R1的兩倍左右,。規(guī)模上,DeepSeek-R2與ChatGPT的GPT-4 Turbo和谷歌的Gemini 2.0 Pro相當,。

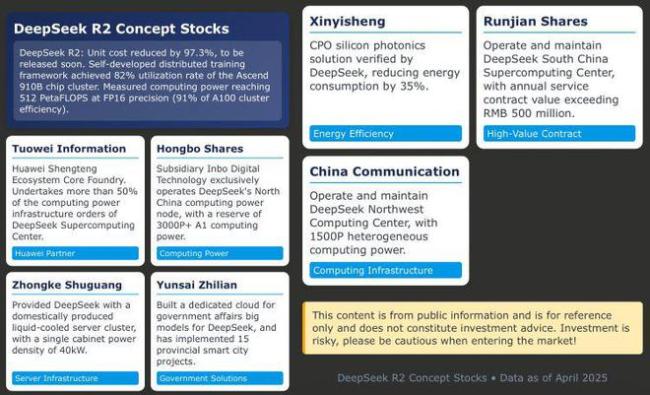

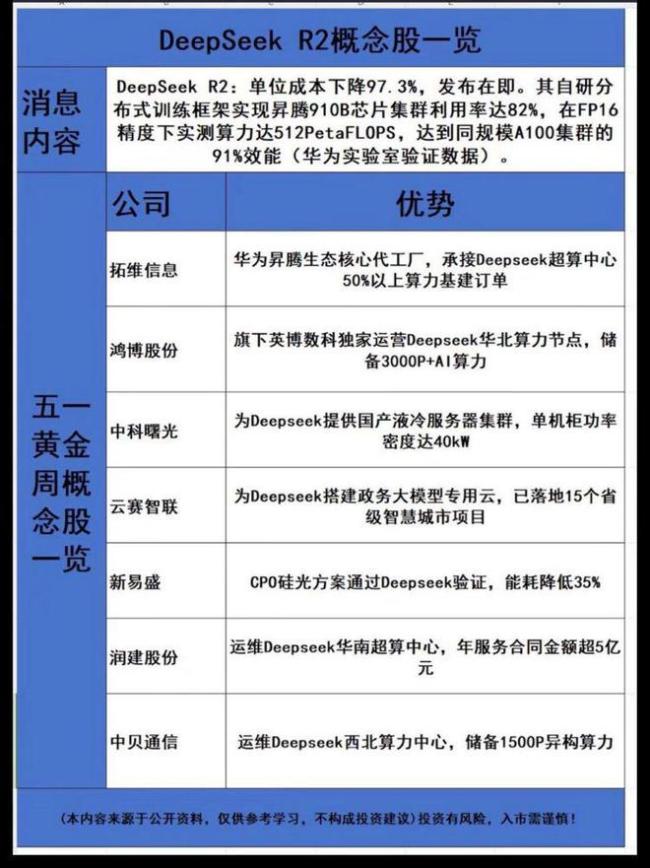

DeepSeek-R2基于華為昇騰910B芯片集群平臺進行訓練,,在FP16精度下實現(xiàn)了512PetaFLOPS的計算性能,芯片資源利用率達到82%,。這一算力約為英偉達A100訓練集群的91%。由于使用華為昇騰910B訓練集群,,DeepSeek-R2的單位推理成本相比GPT-4降低了97.4%,,每百萬token的成本約為0.07美元,而GPT-4則為0.27美元,。

當前美國對英偉達H20芯片的斷供背景下,,采用華為昇騰910B訓練集群有助于減少對海外高端AI芯片的依賴。華為全新的昇騰910C芯片也已開始大規(guī)模量產(chǎn),,CloudMatrix 384超節(jié)點采用了384顆昇騰910C芯片,,有望成為英偉達NVL72集群的替代方案,進一步提升我國人工智能領域的硬件自主化水平,。

(責任編輯:張佳鑫 0764)

關閉

相關新聞

春分都有哪些習俗,?

2025-03-20 08:49:06春分都有哪些習俗爆料:法國秘密演練向烏克蘭派兵

2025-01-16 16:00:33曝法國秘密演練向烏克蘭派兵狗仔爆料,袁姍姍非機動車道內(nèi)亂停車

2025-04-22 15:27:08袁姍姍非機動車道內(nèi)亂停車考研復試都有哪些流程 關鍵步驟詳解

2025-03-14 17:41:21考研復試都有哪些流程公司裁員前都有哪些征兆,?

2025-04-07 12:06:18公司裁員前有哪些征兆,?馬斯克嘲諷拜登是傀儡 議長爆料引爭議

2025-01-20 19:57:59馬斯克嘲諷拜登是傀儡