危險程度堪比核武?“殺人機(jī)器”研發(fā)或引發(fā)災(zāi)難

原標(biāo)題:危險程度堪比核武?“殺人機(jī)器”研發(fā)或引發(fā)災(zāi)難

參考消息網(wǎng)5月14日報道 美國石英財經(jīng)網(wǎng)站5月11日發(fā)表了賈斯廷·羅爾利希的題為《“第3次戰(zhàn)爭革命”是能夠自己決定殺人的武器》的文章,,現(xiàn)將原文編譯如下:

自主致命性武器——批評者稱之為“殺人機(jī)器人”——的出現(xiàn)讓許多分析人士感到驚恐,。在沒有人類近距離控制的情況下,,裝備了人工智能的某些此類武器能以士兵無法企及的速度和效率選定并消滅目標(biāo),。

包括美國在內(nèi)的多個國家正在研發(fā)自主致命性武器,,相關(guān)項目包括裝備人工智能的無人坦克,、無人戰(zhàn)斗機(jī)等,。

各國就此自行實施了一些準(zhǔn)則,,但專家說這些還不夠。美國軍方政策規(guī)定,,無人武器裝備作出開火決定時必須有“適當(dāng)程度的”人類判斷,,但并未對此作出明確定義,而且允許有例外,。美國也是反對在該領(lǐng)域進(jìn)行國際監(jiān)管的少數(shù)國家之一,。

不過,擔(dān)心爆發(fā)軍備競賽的荷蘭非政府組織“和平”反戰(zhàn)組織最新發(fā)表的報告稱,,要想防止最終的災(zāi)難,,除了全面禁止之外別無選擇。

資料圖片:科幻電影《終結(jié)者》中的天網(wǎng)機(jī)器人,。(圖片來源于網(wǎng)絡(luò))

資料圖片:未來士兵想象圖,。(圖片來源于網(wǎng)絡(luò))

這種擔(dān)憂不無道理。人工智能專家認(rèn)為這種武器將引發(fā)“第3次戰(zhàn)爭革命”,。和前兩次戰(zhàn)爭革命——黑色火藥和核彈——一樣,,此類武器系統(tǒng)能迅速證明其價值,讓擁有它們的一方獲得幾乎不可超越的技術(shù)優(yōu)勢,。

如果不加以禁止,,人工智能武器可能在全世界的軍隊中投入使用。就像社交媒體一樣,,在相關(guān)公司強(qiáng)烈抵制——而同時技術(shù)還在飛速發(fā)展——的情況下,,試圖到后來再回溯性地實施監(jiān)管將被證明困難重重。

正如“和平”組織所聲稱的,,“將生死決定權(quán)交給機(jī)器或算法是極不道德的”,。

問題是,我們會及時行動起來嗎,?對于人工智能武器,,快速采取行動極為重要。

推薦閱讀

西班牙點球大戰(zhàn)遭淘汰 葡萄牙大勝瑞士晉級

新華網(wǎng)2022-12-07 10:05:29

中方支持聯(lián)合國在國際人道救援中發(fā)揮組織協(xié)調(diào)作用

新華網(wǎng)2022-12-07 08:03:44

美陪審團(tuán)裁定特朗普集團(tuán)兩家公司稅務(wù)欺詐等罪名

新京報2022-12-07 07:57:06

韓國財閥與前總統(tǒng)女兒離婚 并承認(rèn)自己有婚外子女

海外網(wǎng)2022-12-07 09:41:49

男子買餅需求全被老板說服,?網(wǎng)友:沒見過這樣的pua,!

2022-12-07 10:17:45

胡錫進(jìn):我不相信這個國家里會有絕對反對放開封控的人

胡錫進(jìn)2022-12-07 09:44:10

烏媒:澤連斯基發(fā)視頻,,透露自己在頓巴斯地區(qū) ,,慶祝烏克蘭“建軍節(jié)”

新京報2022-12-07 09:11:19

落馬區(qū)委書記貪腐上億元,,被判19年!剛當(dāng)區(qū)長就安排2人伺候

2022-12-07 10:10:05

曝賴清德對接任民進(jìn)黨主席猶豫不決 民進(jìn)黨各派系明爭暗斗

海峽導(dǎo)報2022-12-07 09:27:44

世界杯死亡之組4隊全部回家 西班牙日本死于點球戰(zhàn)

2022-12-07 09:40:14

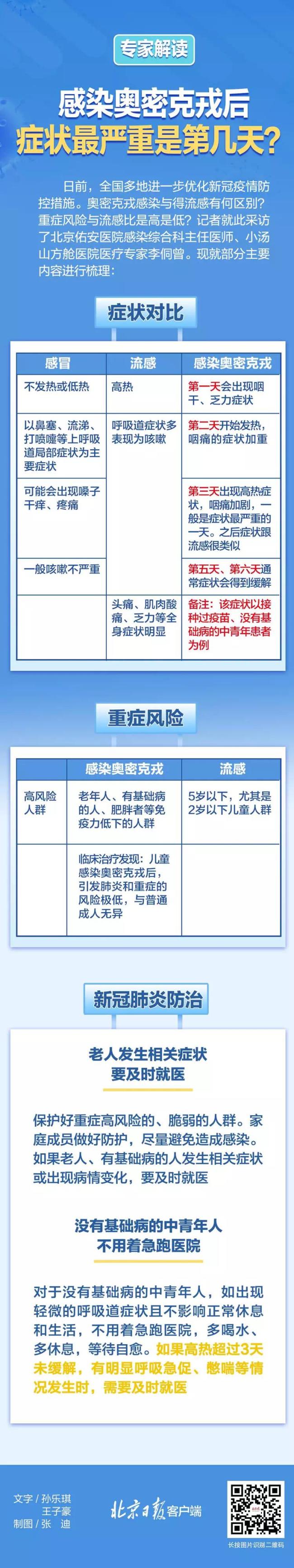

感染奧密克戎后第幾天癥狀最嚴(yán)重,?一圖讀懂

2022-12-07 09:41:48

以色列海上新盾“C-穹頂”問世

海洋防務(wù)前沿2022-12-07 09:21:45

金毛眼球被摳流落街頭被救后離世 多狠毒的心下得去手呢

2022-12-07 10:13:10

專家說新冠肺炎應(yīng)更改名稱:改為新冠病毒傳染病

2022-12-07 09:35:40

網(wǎng)紅主播在尼泊爾被殺 其親屬回應(yīng):他平時愛好旅游

上游新聞2022-12-07 09:51:52

韓國這次面子丟大了,,美軍士兵痛揍韓國人,親美總統(tǒng)卻失聲了

騰訊網(wǎng)2022-12-07 09:01:03

布林肯發(fā)涉中國防疫言論 中方回應(yīng) 這幾年中國疫情防控方針政策是正確、科學(xué),、有效的

環(huán)球網(wǎng)2022-12-07 09:36:02

媒體:久違了!歡迎回家過年 一句話撫慰漂泊游子心

2022-12-07 10:02:01

老師用收費軟件布置作業(yè),?學(xué)?;貞?yīng)

2022-12-07 09:58:54

俄媒:澤連斯基正拍賣烏克蘭,,美國只能借機(jī)收割歐洲資本

騰訊網(wǎng)2022-12-07 09:07:33

朝鮮連續(xù)實彈射擊反制韓美軍演 韓軍多次向朝鮮發(fā)出警告

環(huán)球網(wǎng)2022-12-07 09:33:53

媒體:澤連斯基打算一錘定音拍賣烏克蘭,果然有“頭腦”

海外網(wǎng)2022-12-07 09:04:27

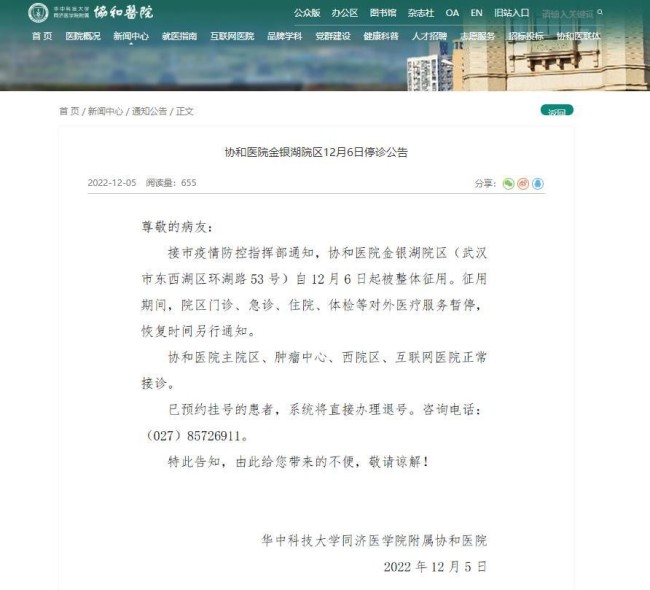

武漢協(xié)和醫(yī)院金銀湖院區(qū)被整體征用 已在該院區(qū)預(yù)約掛號的患者,,系統(tǒng)將直接辦理退號

央廣網(wǎng)2022-12-07 09:37:28

辭職后連夜逃亡的貪官出鏡痛哭:東窗事發(fā),,一逃了之

2022-12-07 10:17:09

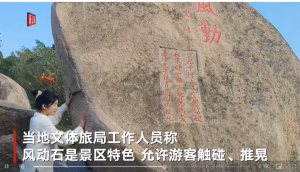

景區(qū)回應(yīng)多人推山頂“風(fēng)動石”:景區(qū)特色 允許推

新京報2022-12-07 10:10:15

馬斯克在一張風(fēng)景圖下的評論火了:畫面來自歐盟最貧窮國家

2022-12-07 09:47:36

曝李四川接受邀請將出任臺北副市長 在蔣萬安“三顧茅廬”之后已決定接受蔣邀請

中國臺灣網(wǎng)2022-12-07 09:29:51

“現(xiàn)在還有人質(zhì)疑我訪華,我覺得很奇怪”

2022-12-07 08:46:27

俄軍裝備“上新” 新一批蘇-35S戰(zhàn)機(jī)即將抵達(dá),,開足馬力生產(chǎn)了

央視網(wǎng)2022-12-07 09:18:01

老人立遺囑不給妻子遺產(chǎn) 法院:所立遺囑無效

2022-12-07 09:39:18

官方回應(yīng)洛陽過年是否讓放鞭炮:禁運,、禁售、禁放

2022-12-07 09:53:35

1.5萬烏軍在巴赫穆特被“包餃子”,,俄稱發(fā)現(xiàn)大批外國雇傭兵

海外網(wǎng)2022-12-07 08:58:20

全國單日票房一度超4000萬 鄭州廣州影院恢復(fù)營業(yè)

2022-12-07 09:34:10

中俄達(dá)成重磅協(xié)議,,面對西方的經(jīng)濟(jì)絞殺戰(zhàn),,俄羅斯終于能喘口氣了

海外網(wǎng)2022-12-07 08:49:08

男孩時隔4個月見父母禮貌喊叔叔 引發(fā)無數(shù)父母感慨

2022-12-07 10:21:11