歐盟達(dá)成人工智能法協(xié)議 預(yù)計(jì)將產(chǎn)生全球性影響(2)

協(xié)議達(dá)成前夕唯一重要的變化就是關(guān)于生成式人工智能模型,,“這些模型的設(shè)計(jì)和開發(fā)必須符合歐盟法律和基本權(quán)利,,包括表達(dá)自由,?!?/p>

《人工智能法》還禁止“有目的的”操縱,?!坝心康牡摹边@個詞有爭議,,因?yàn)榭赡茈y以證明故意性,,但仍被保留下來,。

另外,,在執(zhí)法、邊境管理,、工作場所和教育領(lǐng)域,,法案要求禁止使用AI驅(qū)動的情緒識別軟件。

歐盟立法者對預(yù)測性警務(wù)(predictive policing)的禁令從刑事犯罪擴(kuò)展到了行政犯罪,,其依據(jù)是荷蘭兒童福利丑聞,,該丑聞中成千上萬的家庭因有缺陷的算法而被誤判為欺詐。

高風(fēng)險分類變化

許多人工智能工具可能被認(rèn)為是高風(fēng)險的,,例如用于關(guān)鍵基礎(chǔ)設(shè)施,、執(zhí)法或教育的工具。它們比“不可接受”低一級,因此不會被完全禁止,,但需要在操作中保持高度透明,。高風(fēng)險人工智能的使用者可能需要完成嚴(yán)格的風(fēng)險評估,記錄他們的活動,,并向當(dāng)局提供數(shù)據(jù)以供審查,。這可能會增加公司的合規(guī)成本。

最初的提案將某些關(guān)鍵領(lǐng)域和用例的人工智能解決方案自動歸類為高風(fēng)險,,這意味著供應(yīng)商必須遵守更嚴(yán)格的制度,,包括對風(fēng)險管理、透明度和數(shù)據(jù)治理的要求,。歐洲議會引入了一個額外的層次,,使這些類別的人工智能模型只有在對健康、安全或基本權(quán)利構(gòu)成重大風(fēng)險的情況下才會被視為高風(fēng)險,。

重大風(fēng)險被定義為“由于其嚴(yán)重性,、強(qiáng)度、發(fā)生的概率和影響的持續(xù)時間而具有重大意義的風(fēng)險,,并且能夠影響一個人,、多個人或一個特定群體”。

根據(jù)綠黨的要求,,用于管理能源網(wǎng)或水系統(tǒng)等關(guān)鍵基礎(chǔ)設(shè)施的人工智能,,如果帶來嚴(yán)重的環(huán)境風(fēng)險,也將被歸類為高風(fēng)險,。

此外,,中左翼立法者還爭取到了一個規(guī)定:根據(jù)《數(shù)字服務(wù)法》(DSA)的定義,超大型在線平臺的推薦系統(tǒng)將被視為高風(fēng)險,。

歐洲議會議員為高風(fēng)險人工智能模型的提供者處理敏感數(shù)據(jù)(如性取向或宗教信仰)以檢測負(fù)面偏見的過程,,納入了額外的保障措施。此外,,評估必須發(fā)生在受控環(huán)境中,。敏感數(shù)據(jù)不能被傳輸給其他方,并且必須在偏見評估后被刪除,。提供者還必須記錄數(shù)據(jù)處理發(fā)生的原因,。

《國家法律評論》4月26日報(bào)道稱:“《人工智能法》將產(chǎn)生全球性的影響,因?yàn)樗鼘⑦m用于在歐盟提供或使用人工智能系統(tǒng)的組織,;以及位于第三國(包括英國和美國)的人工智能系統(tǒng)的提供者或使用者,,如果這些人工智能系統(tǒng)產(chǎn)生的輸出在歐盟使用?!?/p>

相關(guān)新聞

歐盟9國呼吁加強(qiáng)人工智能領(lǐng)域合作

2023-09-21 13:52:04歐盟9國呼吁加強(qiáng)人工智能領(lǐng)域合作歐佩克與非歐佩克產(chǎn)油國達(dá)成減產(chǎn)協(xié)議

2023-06-05 07:56:30減產(chǎn)協(xié)議歐盟批準(zhǔn)跨大西洋數(shù)據(jù)傳輸新協(xié)議

2023-07-11 12:51:01歐盟批準(zhǔn)跨大西洋數(shù)據(jù)傳輸新協(xié)議歐盟峰會未就移民政策達(dá)成一致

2023-07-01 04:21:01歐盟峰會未就移民政策達(dá)成一致歐盟領(lǐng)導(dǎo)人非正式會議未就移民問題達(dá)成一致

2023-10-07 06:21:01歐盟領(lǐng)導(dǎo)人非正式會議未就移民問題達(dá)成一致債務(wù)上限協(xié)議尚未達(dá)成 美參議院下周仍將休會一周

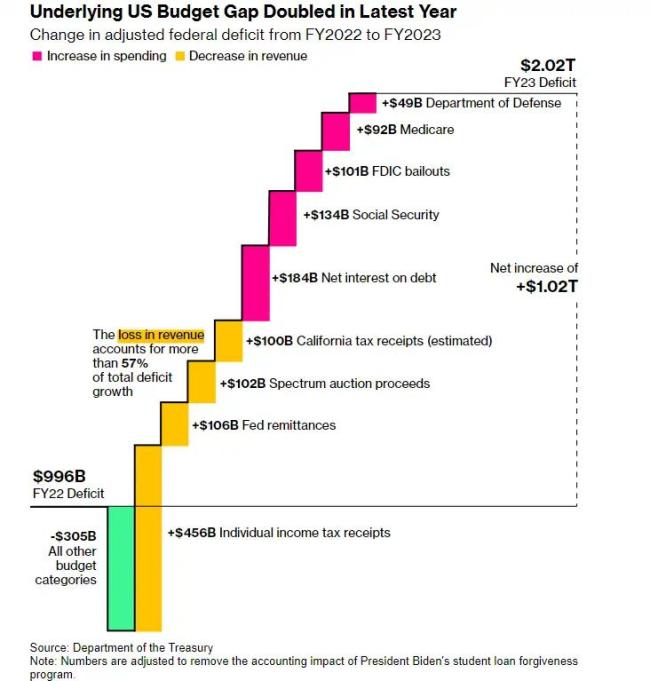

2023-05-19 09:02:03債務(wù)上限