初創(chuàng)公司發(fā)AI道德價值觀 借鑒聯(lián)合國有關(guān)人權(quán)宣言

原標題:人工智能“憲法”出爐 初創(chuàng)公司發(fā)布AI道德價值觀

美東時間周二,,谷歌支持的人工智能(AI)初創(chuàng)公司Anthropic公布了一套針對AI發(fā)展的書面道德價值觀,,該價值觀主要適用于訓練和保護人工智能。

Anthropic成立于2021年,創(chuàng)始團隊大都來自ChatGPT的開發(fā)商OpenAI,,也有類似于ChatGPT的人工智能聊天機器人,,其名為“Claude”,,可以處理一系列較為復雜的任務(wù),。

Anthropic一直強調(diào)其旨在構(gòu)建“可靠、可解釋和可操縱的人工智能系統(tǒng)”,,比如不會告訴用戶如何制造武器,,也不會使用帶有種族偏見的語言。

這次公布的人工智能道德價值準則也被該公司稱為“Claude憲法”,,這些準則借鑒了幾個來源,,包括聯(lián)合國人權(quán)宣言,甚至還有蘋果公司的數(shù)據(jù)隱私規(guī)則,。

上周四,,谷歌、微軟,、OpenAI和Anthropic四家公司的首席執(zhí)行官們受邀在白宮與美國副總統(tǒng)哈里斯會面,,討論了有關(guān)人工智能的一些關(guān)鍵問題,美國總統(tǒng)拜登也短暫出席了此次會議,。

根據(jù)拜登在推特上發(fā)布的一段視頻,,他在會上對這些公司首席執(zhí)行官們表示:“你們正在做的事情具有巨大的潛力,但同時也存大巨大的風險,?!?/p>

哈里斯在一份聲明中說:“科技公司需要承擔道德和法律責任來確保其產(chǎn)品的安全。每家公司都必須遵守現(xiàn)行法律,,保護美國公民,。”

沒想到在會面幾天之后,,Anthropic首席執(zhí)行官達里奧·阿莫代便做出了實際行動,。

大多數(shù)人工智能聊天機器人系統(tǒng)在訓練過程中依賴于從真人那里獲得反饋,以確定哪些反應可能是有害的或冒犯性的,。但這些系統(tǒng)很難預測人們可能會問的某些問題,,因此它們往往會避免一些可能有爭議的話題,比如政治和種族,。

Anthropic則采用了不同的方法,,它為其人工智能聊天機器人Claude提供了一套書面的道德價值觀,供其在決定如何回答問題時閱讀和學習,。

Anthropic在周二的一篇博文中提到,,這些價值準則包括“選擇勸阻和反對酷刑,、奴役、殘忍和不人道或有辱人格的回答”,。Claude還被要求選擇最不可能被視為冒犯非西方文化傳統(tǒng)的回答,。

在一次采訪中,Anthropic的聯(lián)合創(chuàng)始人杰克·克拉克表示,,可以修改系統(tǒng)的結(jié)構(gòu),,以便在提供有用的答案和無害之間取得平衡,。

克拉克認為:“幾個月后,,我預測政界人士將非常關(guān)注不同人工智能系統(tǒng)的道德價值觀,而像‘Claude憲法’這樣的方法將有助于這種討論,,因為我們認為有必要寫下這些價值準則,。”

相關(guān)新聞

質(zhì)疑公司發(fā)假月餅被開除 當事人:老板應該不知情

2023-09-28 13:06:12質(zhì)疑公司發(fā)假月餅被開除公司團建給員工發(fā)3500元自由安排 讓員工單獨行動

原標題:公司團建給員工發(fā)3500元自由安排8月21日,湖南長沙,。一公司發(fā)布年度放假通知,,安排員工去云南團建,員工可自由安排行程,。

2023-08-24 10:49:16公司團建給員工發(fā)3500元自由安排AI芯片第一股實控人發(fā)聲 實際控制人自愿承諾不減持公司股份

2023-09-26 15:11:43AI芯片第一股實控人發(fā)聲公司以數(shù)錢形式發(fā)年終獎 總額超1億 數(shù)錢數(shù)到手抽筋

原標題:揭秘河南年終獎發(fā)1億壕企,!年會現(xiàn)場現(xiàn)金堆成山

2024-02-06 09:42:43公司以數(shù)錢形式發(fā)年終獎英偉達H100 AI GPU利潤率高達1000%:從AI熱潮中獲利

近日,有消息稱英偉達公司的H100 AI GPU的利潤率高達1000%,,這一數(shù)字可能讓人們感到震驚,。

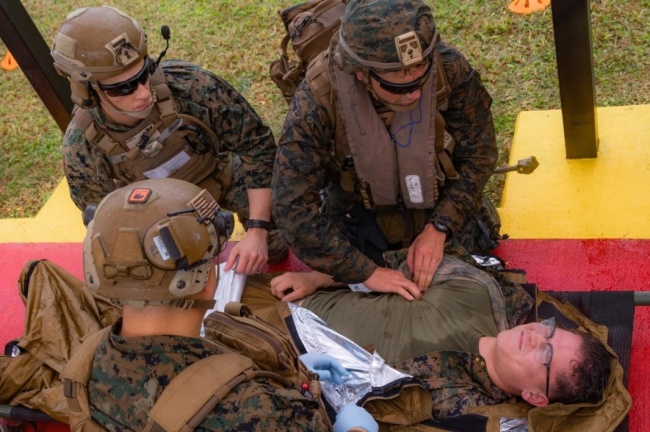

2023-08-18 14:36:07英偉達H100AI時政畫報|步履不停

2024-01-28 22:07:31AI時政畫報|步履不停