DeepSeek推翻兩座大山 低成本訓(xùn)練引發(fā)行業(yè)巨變

DeepSeek的壓力最終傳遞到了黃仁勛身上。英偉達(dá)美股股價(jià)盤前暴跌近11%,,市值縮水超過3500億美元,。資本市場(chǎng)開始懷疑,當(dāng)相對(duì)較少的算力也能實(shí)現(xiàn)與OpenAI相媲美的模型性能時(shí),,高端算力芯片是否正面臨新的泡沫,。

這種擔(dān)憂情緒進(jìn)一步推高了DeepSeek的熱度。短短一周內(nèi),,DeepSeek應(yīng)用在美區(qū)和中國區(qū)App Store免費(fèi)榜上均位列第一,,這是首次有AI助手類產(chǎn)品超越ChatGPT登頂美區(qū)App Store。由于用戶激增,,DeepSeek在兩天內(nèi)接連出現(xiàn)服務(wù)宕機(jī)現(xiàn)象,,官方解釋稱這可能與服務(wù)維護(hù)和請(qǐng)求限制有關(guān)。

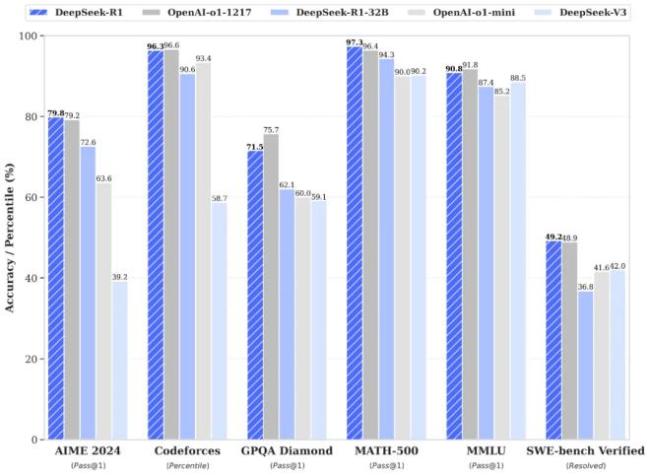

新模型DeepSeek R1是引發(fā)這場(chǎng)全球用戶大討論的直接原因,。R1不僅開源,,還免費(fèi)供全球用戶無限調(diào)用,打破了大廠間的資本比拼游戲,。相比OpenAI在模型上的閉源及付費(fèi)使用限制,,DeepSeek用不到OpenAI十分之一的資源就做出了性能堪比o1的R1。

Meta擔(dān)心即將發(fā)布的Llama 4在性能上可能無法趕上DeepSeek R1,。OpenAI CEO奧特曼也感受到了壓力,,通過發(fā)布首個(gè)智能體Operator搶熱度,并透露即將上線的o3-mini新消息,。

DeepSeek R1在數(shù)學(xué),、代碼、自然語言推理等任務(wù)上的性能可與OpenAI o1模型正式版媲美,。其創(chuàng)新訓(xùn)練方法如R1-Zero路線,直接將強(qiáng)化學(xué)習(xí)應(yīng)用于基礎(chǔ)模型,,無需依賴監(jiān)督微調(diào)和已標(biāo)注數(shù)據(jù),。這種方法提高了訓(xùn)練效率,減少了對(duì)人工干預(yù)的依賴,。

DeepSeek R1的成本遠(yuǎn)低于同類模型,。去年12月發(fā)布的DeepSeek-V3開源基礎(chǔ)模型,性能對(duì)標(biāo)GPT-4o,,但訓(xùn)練成本僅為約557.6萬美元,。相比之下,GPT-4o模型的訓(xùn)練成本約為1億美元,。DeepSeek R1每百萬輸入tokens的價(jià)格為1~4元人民幣,,每百萬輸出tokens為16元人民幣,,而OpenAI o1的運(yùn)行成本約為其30倍。

DeepSeek R1的成功引發(fā)了廣泛關(guān)注,,包括斯坦福大學(xué)計(jì)算機(jī)科學(xué)系客座教授吳恩達(dá)和微軟董事長兼CEO薩提亞·納德拉在內(nèi)的多位大佬都對(duì)其表示關(guān)注,。DeepSeek團(tuán)隊(duì)主要由年輕人才組成,專注于模型研究而不考慮商業(yè)變現(xiàn),。公司選擇了一條理想主義路徑,,只做基礎(chǔ)模型研究,不急于商業(yè)化,。

DeepSeek R1已成為開源社區(qū)Hugging Face上下載量最高的大模型之一,,下載量超過10萬次。Meta AI首席科學(xué)家楊立昆認(rèn)為,,這證明開源模型正在超越專有模型,。DeepSeek未來計(jì)劃繼續(xù)開源旗艦?zāi)P停苿?dòng)開源生態(tài)發(fā)展,。

DeepSeek的成功讓一些初創(chuàng)公司轉(zhuǎn)向其API,,因?yàn)槠鋬r(jià)格更具吸引力。字節(jié)跳動(dòng),、阿里通義以及智譜,、Kimi等團(tuán)隊(duì)也在積極研究DeepSeek。雷軍甚至挖來了DeepSeek的關(guān)鍵開發(fā)者羅福莉,,以增強(qiáng)小米的大模型團(tuán)隊(duì),。國內(nèi)大模型公司面臨壓力,如果不能快速跟進(jìn)R1級(jí)別的模型效果,,客戶可能會(huì)流失,。

相關(guān)新聞

黃金頭頂?shù)膬勺笊?美元國債雙壓金價(jià)

2024-12-30 21:41:02黃金頭頂?shù)膬勺笊?/span>實(shí)測(cè)DeepSeek做奧數(shù)題寫作文 DeepSeek火爆全球

2025-01-27 20:13:31實(shí)測(cè)DeepSeek做奧數(shù)題寫作文DeepSeek徹底爆發(fā) 性能卓越成本低

2025-01-26 15:56:02DeepSeek徹底爆發(fā)DeepSeek核心成員是應(yīng)屆生 小團(tuán)隊(duì)大成就

2025-01-27 19:06:08DeepSeek核心成員是應(yīng)屆生DeepSeek又有重大突破 開源大模型性能卓越

2025-01-21 22:05:22DeepSeek又有重大突破DeepSeek大模型強(qiáng)在哪 引發(fā)硅谷恐慌

短短一個(gè)月內(nèi),中國AI初創(chuàng)公司深度求索(DeepSeek)發(fā)布了兩款大模型:DeepSeek-V3和DeepSeek-R1

2025-01-27 08:21:32DeepSeek大模型強(qiáng)在哪