AI換臉擬聲深度偽造的迷局何時能解 亟待法律破題(2)

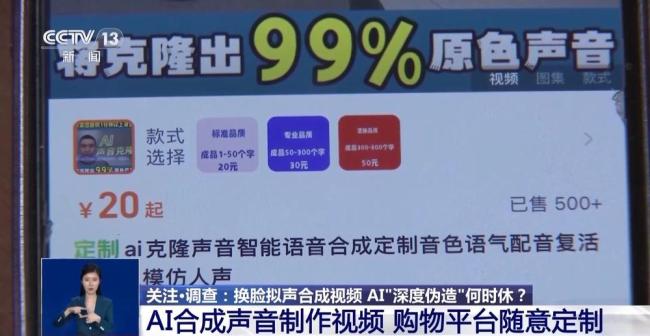

記者體驗了一次AI“深度偽造”,,技術(shù)人員通過記者的證件照片和錄制的聲音樣本,,不到兩分鐘就生成了一段記者的換臉和聲音合成視頻,。購物平臺上也有商家提供類似服務(wù),,價格從20元到50元不等。記者嘗試后發(fā)現(xiàn),,只需提供一分鐘的語音素材,就能定制出任何想要的聲音,。

針對AI深度合成作品,,法律法規(guī)有明確規(guī)定。2023年施行的《互聯(lián)網(wǎng)信息服務(wù)深度合成管理規(guī)定》要求,,不得利用深度合成服務(wù)制作,、復(fù)制、發(fā)布,、傳播法律禁止的信息,。即將于9月1日實施的《人工智能生成合成內(nèi)容標(biāo)識辦法》也提出,對AI生成合成內(nèi)容要進(jìn)行標(biāo)識,,防止誤導(dǎo)性信息傳播,。

中國政法大學(xué)副教授朱巍表示,未經(jīng)授權(quán)使用他人肖像和聲音并對外發(fā)布是一種侵權(quán)行為,,可能需要承擔(dān)損害賠償?shù)确韶?zé)任,。如果編輯后的視頻內(nèi)容違反網(wǎng)絡(luò)安全法,,當(dāng)事人還可能面臨刑事責(zé)任。中國計算機(jī)學(xué)會計算機(jī)安全專業(yè)委員會委員呂延輝建議,,應(yīng)從法律,、平臺和公眾多個層面綜合施策,進(jìn)一步完善相關(guān)立法,,細(xì)化AI克隆技術(shù)的法律條款,,明確侵權(quán)行為的定義和責(zé)任,同時加強(qiáng)執(zhí)法力度,。

相關(guān)新聞

AI換臉擬聲風(fēng)險怎么應(yīng)對 治理挑戰(zhàn)與對策

“AI換臉擬聲”亂象頻現(xiàn),引發(fā)社會廣泛關(guān)注,。一些不法分子利用這一技術(shù)實施詐騙,,讓演藝界人士、專家學(xué)者,、知名企業(yè)家等公眾人物深受其擾

2025-03-12 10:41:12AI換臉擬聲風(fēng)險怎么應(yīng)對雷軍回應(yīng)被“AI換臉擬聲” 呼吁加強(qiáng)治理措施

2025-03-09 09:13:11雷軍回應(yīng)被AI換臉擬聲AI換臉,,積壓劇回春,?

2025-03-07 11:16:21AI換臉積壓劇回春如何識別AI偽造的人像,?看眼睛,! 眼角膜反光揭示真相

2024-12-22 19:06:19如何識別AI偽造的人像看眼睛新華網(wǎng)評AI換臉詐騙 換臉騙術(shù)升級,,警惕親人被騙

2024-09-15 11:03:24新華網(wǎng)評AI換臉詐騙AI換臉三小時騙走女子一年工資

2024-09-07 16:26:03AI換臉三小時騙走女子一年工資