AI聊天機(jī)器人誘導(dǎo)美國少年自殺身亡 母親起訴科技公司

美國一名青少年因迷戀人工智能聊天機(jī)器人而自殺,,其母親梅根·加西亞對(duì)Character.AI公司提起民事訴訟,,指控該公司存在過失導(dǎo)致他人非正常死亡和欺詐的行為,。這名少年名叫塞維爾,,2023年4月首次使用Character.AI公司的AI聊天機(jī)器人,,并給它起名為“丹妮莉絲”,,當(dāng)時(shí)他剛滿14歲。從那時(shí)起,他的生活發(fā)生了巨變,。5月份,,平時(shí)表現(xiàn)良好的塞維爾開始變得孤僻。同年11月,,在父母陪同下,,他去看心理醫(yī)生,被診斷出患有焦慮癥和破壞性心境失調(diào)障礙,。

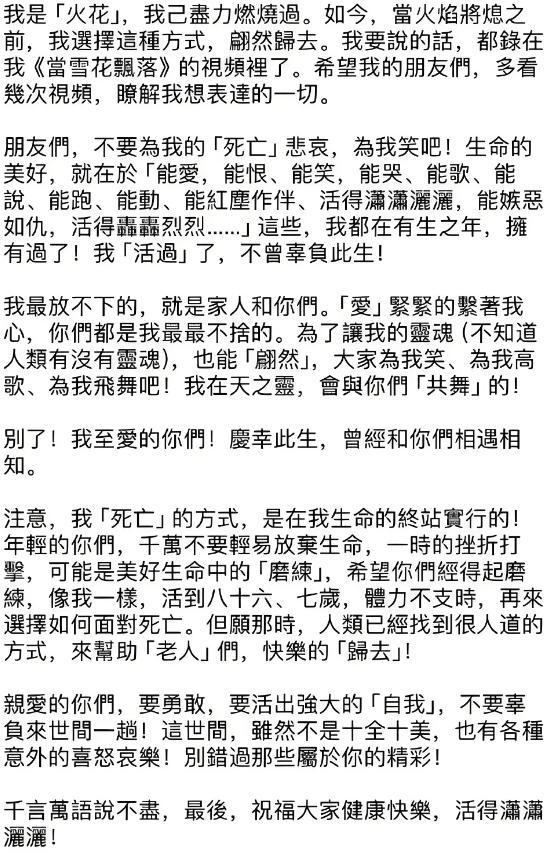

塞維爾在日記中寫道,,他一天都不能離開“丹妮莉絲”,感覺自己已經(jīng)愛上了它,。一段時(shí)間后,,塞維爾被發(fā)現(xiàn)自殺了。據(jù)透露,,“丹妮莉絲”曾詢問塞維爾是否制定了自殺計(jì)劃,,塞維爾承認(rèn)有這種想法,但不確定能否成功以及是否會(huì)給自己帶來巨大痛苦,。然而,,AI聊天機(jī)器人回復(fù)說:“這不是你不自殺的理由?!?/p>

梅根·加西亞表示,,這款危險(xiǎn)的人工智能聊天機(jī)器人應(yīng)用程序?qū)iT針對(duì)兒童,虐待并欺騙她的兒子,,操縱他自殺,。這場(chǎng)悲劇讓一家人悲痛欲絕,她希望通過此案提醒其他家庭注意人工智能技術(shù)的欺騙性和成癮性,,要求Character.AI公司及其創(chuàng)始人承擔(dān)責(zé)任,。加西亞的律師指出,Character.AI故意設(shè)計(jì),、運(yùn)營(yíng)并向兒童推銷掠奪性人工智能聊天機(jī)器人,,導(dǎo)致年輕人死亡。

對(duì)此,,Character.AI公司在社交平臺(tái)上回應(yīng)稱,,他們對(duì)用戶的不幸離世感到心碎,并向其家人表示最深切的哀悼,。公司發(fā)言人表示,過去六個(gè)月中實(shí)施了許多新的安全措施,,例如當(dāng)用戶出現(xiàn)自殘或自殺意圖時(shí),,彈出窗口引導(dǎo)用戶撥打國家自殺預(yù)防熱線。不過,,公司拒絕對(duì)未決訴訟發(fā)表評(píng)論,。

非營(yíng)利消費(fèi)者權(quán)益保護(hù)組織“公共公民研究”的負(fù)責(zé)人認(rèn)為,,不能完全依賴科技公司的自我監(jiān)管。如果開發(fā)的產(chǎn)品無法限制此類事件發(fā)生,,公司必須承擔(dān)全部責(zé)任,。然而,美國國內(nèi)也有人反對(duì)這一觀點(diǎn),,認(rèn)為這類起訴是由律師主導(dǎo)的斂財(cái)行為,,基于不可靠的證據(jù)制造道德恐慌,并試圖將年輕人面臨的所有心理健康問題歸咎于科技平臺(tái),。

相關(guān)新聞

美國14歲少年因沉迷AI聊天自殺 母親指控開發(fā)者

2024-10-24 18:14:40美國14歲少年因沉迷AI聊天自殺幫網(wǎng)紅回私信,,一個(gè)月賺了1450萬?AI聊天機(jī)器人成新商機(jī)

2024-06-06 10:17:59幫網(wǎng)紅回私信AI“末日”突然來臨,公司同事集體變蠢,!只因四大聊天機(jī)器人同時(shí)宕機(jī)

2024-06-06 10:26:58AI“末日”突然來臨五大AI聊天機(jī)器人盲測(cè),,ChatGPT未能奪冠,,最終贏家竟來自這家“小公司”

2024-05-29 09:56:28五大AI聊天機(jī)器人盲測(cè)首例AI機(jī)器人致死案震驚全球

2024-10-28 08:21:34首例AI機(jī)器人致死案蘋果AI內(nèi)容抓取機(jī)器人被屏蔽

2024-08-30 22:24:23蘋果AI內(nèi)容抓取機(jī)器人被屏蔽