AI仿冒名人帶貨屬違法行為 深度偽造技術(shù)隱患顯現(xiàn)(2)

盡管AI模仿度高,,但并非毫無破綻,。專家表示,,這種既要換臉又要換聲的操作只能制作視頻,,無法做到實(shí)時(shí)直播。觀眾通過仔細(xì)辨認(rèn)視頻,,也能看出AI的痕跡,。辨別時(shí)可以重點(diǎn)關(guān)注視頻中人臉的變換,,包括人臉輪廓和背景環(huán)境融合度,、協(xié)調(diào)度等,。另外,在語音,、語速和口型的匹配度上也可以去重點(diǎn)關(guān)注,。

未經(jīng)授權(quán)利用AI假冒他人屬違法行為。專家表示,,那些未經(jīng)允許使用他人形象的行為均屬于違法行為,。按照民法典的規(guī)定,未經(jīng)權(quán)利人同意,,任何人不得侵害他人的人格權(quán)利,。不僅不能直接使用,也不能使用當(dāng)事人的人臉信息,、聲音信息進(jìn)行深度合成,。如果把相關(guān)視頻,包括聲音編輯之后形成了相關(guān)內(nèi)容,,這屬于偽造的信息,,按照網(wǎng)絡(luò)安全法的規(guī)定,這屬于違法信息,。此外,,AI假冒名人發(fā)表自己的作品,有可能會追究發(fā)布者的刑事責(zé)任,。

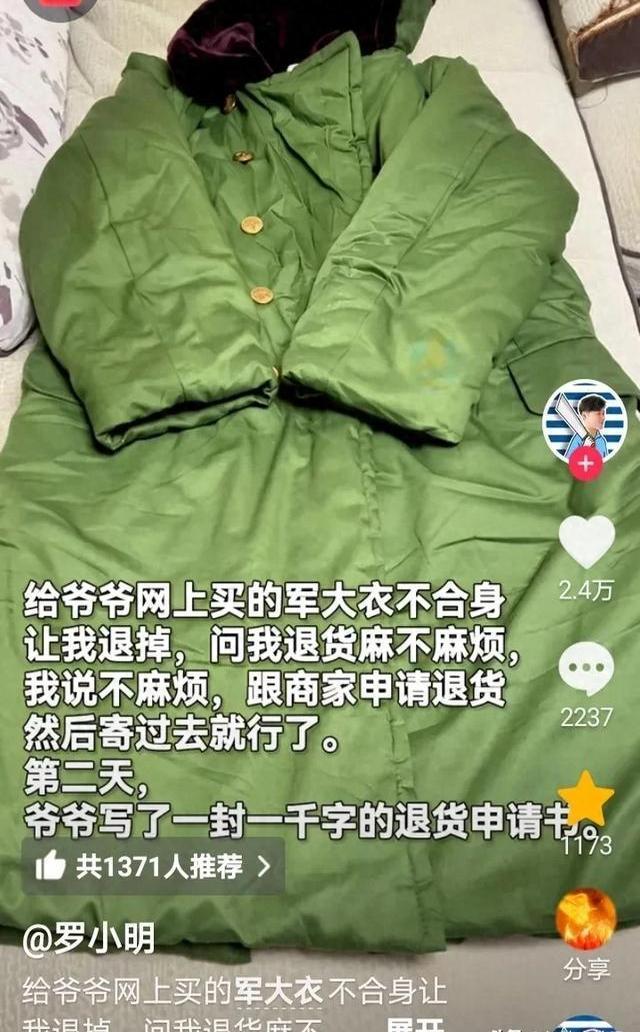

專家表示,,AI假冒名人進(jìn)行帶貨這樣的行為已經(jīng)涉嫌違法,一旦消費(fèi)者信以為真購買了產(chǎn)品,,可以要求商家退一賠三,。消費(fèi)者權(quán)益保護(hù)法明確規(guī)定,如果消費(fèi)者遭到了欺詐,,可以要求不法商家進(jìn)行賠償,。具體的賠償標(biāo)準(zhǔn)是退一賠三,如果不足500元,,消費(fèi)者完全可以要求商家按照500元進(jìn)行賠償,。短視頻平臺也應(yīng)該擔(dān)負(fù)主體責(zé)任,有義務(wù)防范AI假冒名人視頻在自己的平臺大量傳播,。如果發(fā)現(xiàn)利用AI合成的聲頻和視頻傳播虛假消息,,應(yīng)當(dāng)對發(fā)布者采取包括信用管理在內(nèi)的強(qiáng)制措施,根據(jù)信用的降低,,要隨之產(chǎn)生必要的處罰措施,。

相關(guān)新聞

AI仿冒名人帶貨屬違法行為 消費(fèi)者可要求退一賠三

2024-12-23 07:43:53退一賠三央視揭AI假冒名人帶貨亂象 深度偽造頻發(fā)

2024-12-23 15:10:02央視揭AI假冒名人帶貨亂象記者實(shí)測AI換臉搭配聲音合成 揭秘假冒名人帶貨亂象

2024-12-23 13:42:45記者實(shí)測AI換臉搭配聲音合成堵車時(shí)闖綠燈屬違法行為

2024-12-02 10:38:26堵車時(shí)闖綠燈屬違法行為張文宏“被AI帶貨”,,監(jiān)管如何跟上技術(shù)發(fā)展,?

2024-12-14 15:08:21張文宏“被AI帶貨”堵車時(shí)闖綠燈屬違法行為 影響通行效率

2024-12-02 10:13:03堵車時(shí)闖綠燈屬違法行為