DeepSeek深夜發(fā)新品 跑分力壓OpenAI 圖像生成新突破

中國公司DeepSeek在華爾街周一緊張評估“DeepSeek風暴”時,,推出了新產(chǎn)品:開源的多模態(tài)大模型Janus-Pro,。這款模型在圖像生成基準測試中超越了OpenAI的DALL-E 3,。

除夕夜前夕,,DeepSeek工程師們在“抱抱臉”平臺上發(fā)布了Janus Pro 7B和1.5B模型,,這是對去年10月發(fā)布的Janus模型的升級,。這兩個模型分別具有15億和70億參數(shù)量,,可以在消費級電腦上本地運行,。與之前的版本一樣,,Janus Pro采用MIT許可證,,在商用方面沒有限制。

據(jù)介紹,,Janus-Pro采用了新穎的自回歸框架,,統(tǒng)一了多模態(tài)理解和生成。通過將視覺編碼分為“理解”和“生成”兩條路徑,,并使用單一的Transformer架構(gòu)處理,,解決了以往方法的局限性。這種設計不僅緩解了視覺編碼器在理解和生成中的角色沖突,還提高了框架的靈活性,。

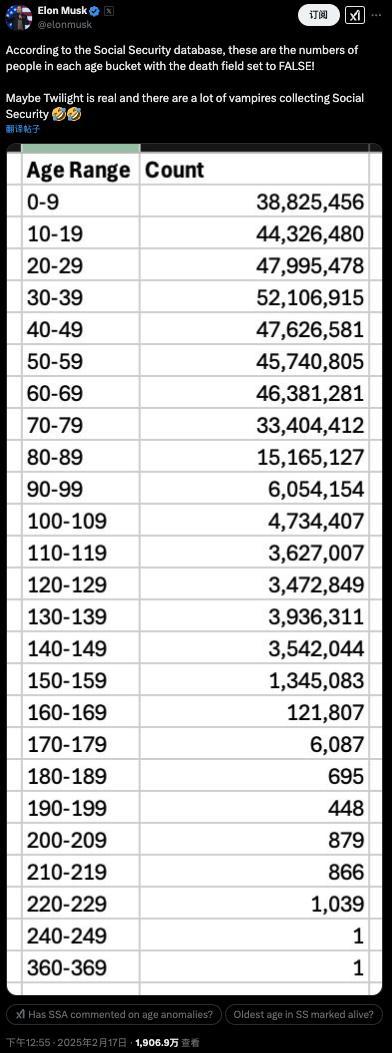

從報告給出的數(shù)據(jù)來看,,Janus-Pro 70億參數(shù)模型在部分文生圖基準測試中表現(xiàn)優(yōu)于OpenAI的DALL-E 3和Stability AI的Stable Diffusion 3-Medium。盡管DALL-E 3是2023年發(fā)布的老模型,,且Janus Pro目前只能分析和生成較小規(guī)格的圖像(384 x 384),,但其性能仍然令人印象深刻。

技術(shù)報告顯示,,Janus-Pro在視覺生成方面通過添加7200萬張高質(zhì)量合成圖像,,使得真實數(shù)據(jù)與合成數(shù)據(jù)的比例達到1:1,從而實現(xiàn)更具視覺吸引力和穩(wěn)定性的圖像輸出,。此外,,新模型在多模態(tài)理解的訓練數(shù)據(jù)方面參考了DeepSeek VL2并增加了約9000萬個樣本。

作為多模態(tài)模型,,Janus-Pro不僅可以“文生圖”,,還能對圖片進行描述、識別地標景點(如杭州西湖),、識別圖像中的文字,,并能介紹圖片中的知識(例如“貓和老鼠”蛋糕)。公司也在報告中展示了更多圖像生成的案例,。

相關(guān)新聞

OpenAI宣稱DeepSeek違規(guī) 引發(fā)行業(yè)震動

2025-01-30 08:56:02OpenAI宣稱DeepSeek違規(guī)OpenAI CEO談DeepSeek:令人振奮的新競爭者出現(xiàn)

2025-01-28 13:14:09令人振奮周鴻祎:DeepSeek才是真正的OpenAI 引發(fā)安全爭議

近日,美國多名官員對DeepSeek的影響表示擔憂,,稱其為“偷竊”,,并正在對其展開國家安全調(diào)查

2025-01-31 11:49:55周鴻祎OpenAI奧特曼:DeepSeek令人印象深刻 歡迎新競爭對手

2025-02-04 18:00:03DeepSeek令人印象深刻實測DeepSeek深度思考模式 低成本高效挑戰(zhàn)OpenAI

2025-01-27 23:02:39實測DeepSeek深度思考模式DeepSeek威脅下 OpenAI考慮開源策略 應對競爭挑戰(zhàn)

2025-02-05 11:17:49DeepSeek威脅下OpenAI考慮開源策略