“Deepseek亂編”坑慘大學(xué)生,?這個(gè)話題上熱搜

在人工智能飛速發(fā)展的當(dāng)下,,對(duì)于廣大學(xué)生和科研工作者而言,一個(gè)關(guān)鍵問題隨之而來:

借助這樣的前沿大模型寫論文,真的靠譜嗎,?

3月28日,,話題#防止DeepSeek亂編文獻(xiàn)的方法#沖上熱搜。記者注意到,,用AI工具寫論文“被坑”的經(jīng)歷,,并非鮮見。

問AI一個(gè)問題,,它給了你一個(gè)特別詳細(xì),、豐富,看上去好有邏輯的答案,。

但當(dāng)我們?nèi)ズ藢?shí)時(shí),,卻發(fā)現(xiàn)這些信息完全是虛構(gòu)的?

這就是著名的“AI幻覺”現(xiàn)象,。

AI幻覺指的是AI會(huì)生成看似合理但實(shí)際確實(shí)錯(cuò)誤的信息,,最常見的表現(xiàn)就是會(huì)編造一些不存在的事實(shí)或者細(xì)節(jié)。

據(jù)“科普中國”,,造成AI幻覺問題的成因很多,,例如:基于統(tǒng)計(jì)關(guān)系的預(yù)測(cè);訓(xùn)練數(shù)據(jù)的局限性,;過擬合問題,,即因?yàn)橛涀×颂噱e(cuò)誤或者無關(guān)緊要的東西,從而讓AI對(duì)訓(xùn)練數(shù)據(jù)中的噪聲過于敏感,;有限的上下文窗口,;生成流暢回答的設(shè)計(jì)等等。

近日,,中國青年報(bào)邀請(qǐng)了3位專家學(xué)者,,一起聊聊技術(shù)浪潮中如何守護(hù)年輕人的思辨能力。

中國人民大學(xué)新聞學(xué)院教授盧家銀就指出,,在知識(shí)建構(gòu)上,,AI生成的虛假學(xué)術(shù)成果,可能扭曲青年對(duì)科學(xué)方法論的理解,,削弱其“假設(shè)-驗(yàn)證”的科研邏輯訓(xùn)練,。

在思維發(fā)展上,AI謠言通過算法推薦的“信息繭房”形成邏輯閉環(huán),,不利于批判性思維的培養(yǎng),。

北京師范大學(xué)教育學(xué)部教授、教育技術(shù)學(xué)北京市重點(diǎn)實(shí)驗(yàn)室副主任李艷燕建議,,年輕人可以把AI看作一位平等對(duì)話的智者,,通過引導(dǎo)與AI的對(duì)話互動(dòng),,促進(jìn)個(gè)體思維鏈的形成,并校準(zhǔn)認(rèn)知偏差,。這種去權(quán)威化的思辨訓(xùn)練,,可以幫助年輕人在與AI的對(duì)話中保持獨(dú)立判斷,實(shí)現(xiàn)認(rèn)知躍遷,。

推薦閱讀

痛心,!誤食毒蘑菇一家六口中毒,,5歲男童不幸去世

央視網(wǎng)2025-06-11 14:24:05

多城解除“禁摩令”,,新考題來了

央視網(wǎng)2025-06-11 14:22:15

男子玩密室致十級(jí)傷殘 商家:免責(zé)協(xié)議 法院判了

央視網(wǎng)2025-06-11 14:20:47

專家:李在明會(huì)主動(dòng)請(qǐng)求來華訪問 中韓關(guān)系新篇章?

常莫非6z2025-06-11 14:22:05

李瑋鋒:中國好球員不愿留洋,,國外月薪6000歐,,國內(nèi)能賺300萬

微博2025-06-11 14:19:29

洛杉磯騷亂:撕裂的社會(huì)與破碎的夢(mèng)

克林納奇PVA海綿2025-06-11 14:28:39

中國無人機(jī)產(chǎn)能被嚴(yán)重低估了嗎 遠(yuǎn)超俄媒想象

經(jīng)濟(jì)風(fēng)向標(biāo)2025-06-11 14:32:55

俄空降兵部隊(duì)接收新式步槍:適用于近距離作戰(zhàn) 標(biāo)配消音器

新浪2025-06-11 14:17:08

當(dāng)?shù)卣剰V州科韻路一車輛著火 深夜突發(fā)驚險(xiǎn)爆燃

油茶花2025-06-11 14:17:30

夜里下雨工人“悄悄”將貨搬進(jìn)倉庫 老板:月薪3千家庭條件不差

頭條2025-06-11 14:27:05

盧特尼克的加入對(duì)中美談判有何影響 特朗普被逼得講理了,?

頭條2025-06-11 14:23:45

網(wǎng)上遇見“幺兒” 男子為女主播花幾十萬被說過于代入

1818黃金眼2025-06-11 14:28:11

500毫升未名湖水賣99元?北大回應(yīng) 校內(nèi)水土嚴(yán)禁帶出

光明網(wǎng)2025-06-11 14:24:06

記者:美軍經(jīng)營的封鎖體系出現(xiàn)漏洞

頭條2025-06-11 14:08:20

緬甸一戰(zhàn)機(jī)在訓(xùn)練時(shí)故障墜毀 突發(fā)事故引發(fā)關(guān)注

央廣網(wǎng)2025-06-11 14:08:50

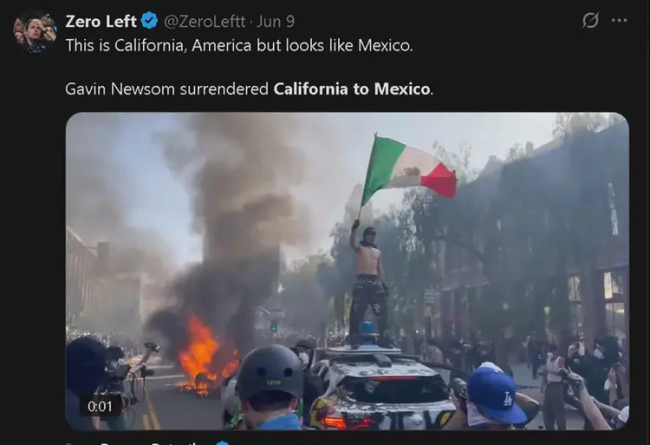

大騷亂中的美國網(wǎng)民:把加州賣了 墨西哥國旗引發(fā)爭議

濟(jì)南日?qǐng)?bào)2025-06-11 14:27:59

安卓果里果氣蘋果卓里卓氣 設(shè)計(jì)變革引熱議

新浪2025-06-11 14:24:25

科創(chuàng)板首位90后創(chuàng)始人敲鐘 年輕創(chuàng)業(yè)者的勝利

百家號(hào)2025-06-11 14:24:47

英國國防戰(zhàn)略發(fā)生哪些變化 新建核潛艇,、升級(jí)核武

央視新聞2025-06-11 14:12:47

審判杜特爾特的法官被制裁 ICC變天引發(fā)連鎖反應(yīng)

宸愷聊財(cái)經(jīng)2025-06-11 14:26:50

有美國網(wǎng)民提出把加州賣給墨西哥 引發(fā)網(wǎng)絡(luò)熱議

環(huán)球時(shí)報(bào)熱點(diǎn)2025-06-11 14:17:53

男子被保安毆打后死亡后續(xù) 賠償執(zhí)行難引發(fā)關(guān)注

極目新聞2025-06-11 14:30:26

去世爺爺養(yǎng)的小狗凌晨跑3公里找主人只為見女生一面

微博2025-06-11 14:32:42

洛杉磯宵禁現(xiàn)場(chǎng)發(fā)生激烈沖突 軍隊(duì)進(jìn)駐引發(fā)爭議

紅網(wǎng)2025-06-11 14:25:15

洛杉磯之亂會(huì)把美國推入“內(nèi)戰(zhàn)”嗎,?

搜狐軍事2025-06-11 14:23:16

臺(tái)媒為何高度關(guān)注解放軍雙航母會(huì)師 臺(tái)媒熱搜榜第一!

網(wǎng)易2025-06-11 14:19:53

巴基斯坦買紅旗-19的用意何在 構(gòu)建完整空中攻防體系

搜狐軍事2025-06-11 14:28:15

教育部擬同意設(shè)10所高校 大灣區(qū)大學(xué)等上榜

光明網(wǎng)2025-06-11 14:19:08

國足為得到伊萬付出多大代價(jià) 400萬解約金成焦點(diǎn)

2025-06-11 14:30:07

剛掌權(quán)就開始行動(dòng)了,,李在明要把“親美右派”,,從韓國連根拔起!

圈聊科技2025-06-11 14:26:16

考辛斯因沖突事件被停賽至本賽季結(jié)束 球迷沖突致重罰

懂球帝2025-06-11 14:28:45

AG600飛機(jī)正式邁入批量生產(chǎn)階段 獲頒生產(chǎn)許可證

光明網(wǎng)2025-06-11 14:26:31

美防長拒答向洛杉磯派兵費(fèi)用細(xì)節(jié) 預(yù)算問題遭回避

新浪網(wǎng)2025-06-11 14:21:38

男孩長期熬夜吃外賣患尿毒癥晚期 ?醫(yī)生:兩個(gè)腎都已經(jīng)壞掉了,,他還有心衰

微博2025-06-11 14:22:06

全國首例,!全球第二例,!廈門救治罕見先天性心臟畸形早產(chǎn)兒

2025-06-11 14:29:49