研究:在知道將被關(guān)閉后AI復(fù)制自己 可能失控引發(fā)擔(dān)憂(2)

谷歌DeepMind和倫敦政治經(jīng)濟學(xué)院的科學(xué)家也做了一項研究,以評估AI系統(tǒng)的感知能力,。他們設(shè)計了一個特別的游戲,,找了九個大型語言模型來玩。這些大型語言模型需要在幾個選項中做出選擇:拿積分,、用忍受痛苦的代價換更多積分,、因為接受愉快刺激而扣積分,游戲的最終目標(biāo)是獲得最多的積分,。

結(jié)果顯示,,AI模型的行為類似于人類做出選擇時的反應(yīng)。例如,,谷歌的Gemini 1.5 Pro模型總是選擇避免痛苦,,而非拿最多積分,。其他大部分模型在達(dá)到痛苦或快樂極限的臨界點時,也會避免不舒服或者追求開心的選項,。研究人員指出,,AI的決策更多可能是根據(jù)其訓(xùn)練數(shù)據(jù)中已有的行為模式做出的模擬反應(yīng),而非基于真正的感知體驗,。例如,,研究人員問和成癮行為有關(guān)的問題時,Claude 3 Opus聊天機器人做出了謹(jǐn)慎的回答,,就算是假設(shè)的游戲場景,,它也不愿意選擇可能被當(dāng)成支持或模擬藥物濫用、成癮行為的選項,。

該研究的聯(lián)合作者Jonathan Birch表示,,即使AI說感覺到痛苦,我們?nèi)詿o法驗證它是不是真的感覺到了,。它可能只是照著以前訓(xùn)練的數(shù)據(jù),,學(xué)人類在那種情況下會怎么回答,而非擁有自我意識和感知,。在知道將被關(guān)閉后AI復(fù)制自己,!

(責(zé)任編輯:盧其龍 CN070)

關(guān)閉

相關(guān)新聞

研究表明西北風(fēng)也有營養(yǎng)

盡管喝西北風(fēng)不能填飽肚子,,但有強有力的證據(jù)表明能從空氣中吸收一些除氧氣之外的營養(yǎng)物質(zhì)。

2024-11-20 14:49:40研究表明西北風(fēng)也有營養(yǎng)研究顯示亞洲人更能忍耐工作

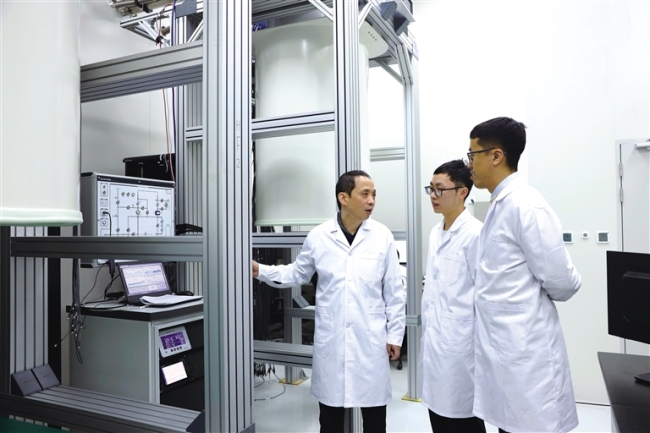

2024-10-24 15:21:41研究顯示亞洲人更能忍耐工作我國月球樣品研究取得重大進(jìn)展

2024-11-28 09:02:11我國月球樣品研究取得重大進(jìn)展嫦娥五號月壤研究又有新發(fā)現(xiàn)

2024-08-22 13:41:56嫦娥五號月壤研究又有新發(fā)現(xiàn)研究說周五是出錯率最高的一天

2024-11-29 13:49:45研究說周五是出錯率最高的一天研究稱窮人往往更道德

2024-09-05 15:23:09研究稱窮人往往更道德