AI最可怕的不是取代人類,,是已經(jīng)讓我們不相信看到的是真照片 真假難辨的時(shí)代來(lái)臨

觀察下面這張圖片,你認(rèn)為這是真實(shí)拍攝的還是AI生成的?看著有些可疑,,比如汽車車門和堆疊的樣子像是拼接起來(lái)的,。那么下面這兩張呢,?如果不仔細(xì)查證,,可能難以相信:它們?nèi)际桥臄z的真實(shí)照片,。

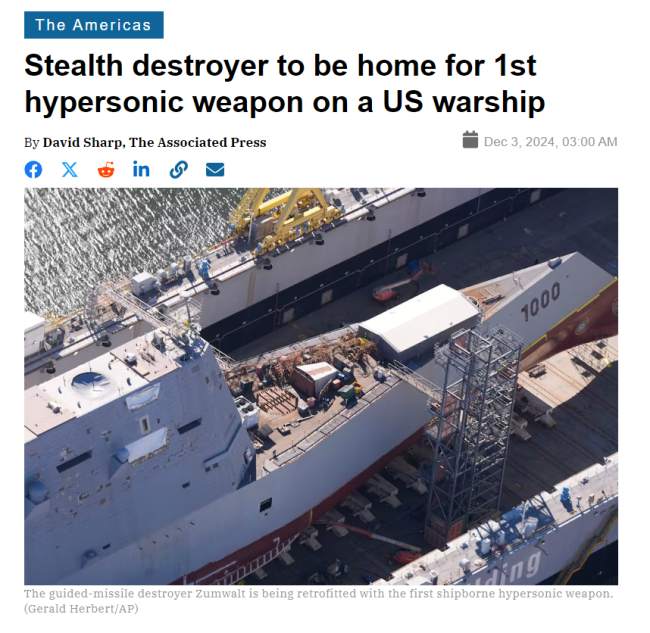

十月底開(kāi)始,,西班牙瓦倫西亞地區(qū)經(jīng)歷特大暴雨,,一天的降雨量相當(dāng)于一年,還持續(xù)不斷,。瓦倫西亞地區(qū)的街道有很多斜坡,,這么大的水量足以讓汽車浮起來(lái),并沿著斜坡一路往下,。當(dāng)洪水退去后,,就出現(xiàn)了最初的照片中的景象。

面對(duì)這些照片時(shí),,許多人的反應(yīng)是:這肯定是AI做的,,假新聞。也不能說(shuō)這些人不講理,,確實(shí)曾經(jīng)被騙過(guò),。之前美國(guó)佛羅里達(dá)州被颶風(fēng)襲擊時(shí),一張穿救生衣的小女孩在救生艇上抱著小狗流淚的圖片橫掃了社交網(wǎng)絡(luò),。這張圖比上面的暴雨圖更顯“AI味”,,從手指細(xì)節(jié)到身體姿勢(shì)都有種說(shuō)不出的怪異。原帖主并不知道這張圖來(lái)自何處,,只是表達(dá)了對(duì)受災(zāi)人民的同情?,F(xiàn)在平臺(tái)已經(jīng)補(bǔ)充了背景信息,強(qiáng)調(diào)這是一張生成的圖片而非真實(shí)拍攝的照片,。

雖然懷疑精神在某些情況下幫助平臺(tái)迅速反應(yīng)并補(bǔ)充警告,,但在另一場(chǎng)災(zāi)難中卻不再奏效。畢竟,,AI生成的圖像越來(lái)越真假難辨,。一次次有人用AI圖博眼球,最終變成了大型“狼來(lái)了”現(xiàn)場(chǎng),。

在評(píng)價(jià)AI生成的圖片或視頻時(shí),,是否足夠?qū)憣?shí)一直是最重要的標(biāo)準(zhǔn)之一。這對(duì)模型提出了很多挑戰(zhàn):是否掌握自然語(yǔ)言規(guī)則,?是否理解常識(shí)和現(xiàn)實(shí)世界的規(guī)律,?能否理解上下文信息并呈現(xiàn)出來(lái),?這是對(duì)模型能力的考驗(yàn),也是反映技術(shù)力的有效指標(biāo),。

一開(kāi)始,,大家為AI能夠生成逼真的圖像而興奮,但后來(lái)越來(lái)越多的“開(kāi)局一張圖,,剩下全靠編”的新聞出現(xiàn),,而且越來(lái)越難以分辨。六月時(shí),,社交媒體上出現(xiàn)了西安發(fā)生特大爆炸的消息,,時(shí)間地點(diǎn)俱全,。但西安警方核實(shí)后發(fā)現(xiàn)并無(wú)此事,。這條消息是由一家MCN機(jī)構(gòu)發(fā)布的。主犯交代自己利用了AI工具,,給定提示詞后,,工具會(huì)自動(dòng)抓取相關(guān)文章并生成幾百到上千字的文本。最高峰時(shí)一天能生成4000至7000條信息,,幾乎不需要人工參與,,專門挑民生相關(guān)、熱度高的話題和事件,。研究表明,,消極、負(fù)面,、激發(fā)情緒的信息更容易抓住人的注意力,。騙子的日均收入高達(dá)1萬(wàn)元,這讓閱讀,、轉(zhuǎn)發(fā)和評(píng)論這種假消息的用戶感到氣憤,。

相關(guān)新聞

一夜淘汰700人,ChatGPT之母:AI自動(dòng)化取代人類,,創(chuàng)意性工作可能消失

2024-06-24 14:19:56一夜淘汰700人AI正準(zhǔn)備將人類送進(jìn)監(jiān)獄

2024-09-02 13:35:33AI正準(zhǔn)備將人類送進(jìn)監(jiān)獄比颶風(fēng)更可怕的,是一張AI生成圖片 黨派斗爭(zhēng)新武器

2024-10-15 09:59:47比颶風(fēng)更可怕的什么工作會(huì)最先被AI取代 八大職業(yè)警報(bào)響起

2024-06-21 11:46:21什么工作會(huì)最先被AI取代馬斯克寧愿親眼見(jiàn)證AI毀滅人類,!

2024-06-21 10:33:27馬斯克寧愿親眼見(jiàn)證AI毀滅人類Perplexity更新,!AI搜索的下一步,,是取代內(nèi)容生產(chǎn)行業(yè)?

Perplexity在2022年12月啟動(dòng),,是早期投入使用的生成式搜索引擎之一,,也被稱作回答引擎,。

2024-06-05 13:50:44Perplexity更新,!AI搜索的下一步