AI最可怕的不是取代人類,,是已經(jīng)讓我們不相信看到的是真照片 真假難辨的時代來臨(2)

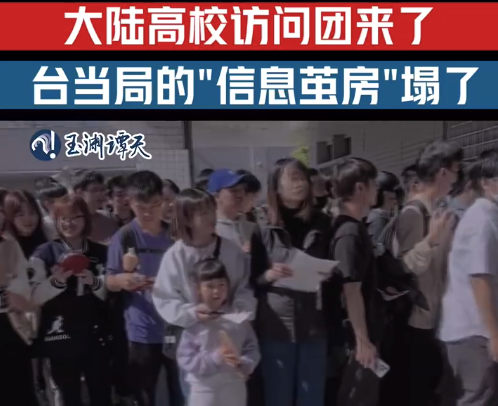

假照片不僅騙過了所有人的眼睛,,還造成了市場恐慌,。去年五月,一張五角大樓發(fā)生爆炸的照片迅速流傳,。由于發(fā)布在美國股市開盤時間,,許多投資相關(guān)的網(wǎng)站和社媒賬戶轉(zhuǎn)發(fā),,導(dǎo)致標準普爾500指數(shù)下跌0.3%,,黃金和美國國債價格小漲,。最后轄區(qū)消防部門辟謠才平息事態(tài)。

太依賴“眼見為實”不僅會傷害感情還會傷害錢包,,于是出現(xiàn)了反向操作:一律打成AI,。這樣做的一個原因是躲開平臺推送。Meta明確表示要高舉AI大旗,,扎克伯格認為有必要專門加一個版塊給AI生成或輔助生成的內(nèi)容。Meta旗下有Facebook和Instagram兩個重要內(nèi)容平臺,,在前者上,,AI生成內(nèi)容越來越多見,因為激勵政策很誘人:每個超過1000贊的帖子最高可獲10美元曝光獎勵,。如果堅定執(zhí)行“一律打成AI”的路線,,有效打擊假消息傳播,倒逼平臺不再推流量,、給補貼,,也許是個可行的方法。沒有買賣就沒有傷害,。

然而,,這種真假難辨的情況可能會讓真正的傷害消失在互聯(lián)網(wǎng)的信息海洋中?;ヂ?lián)網(wǎng)觀察基金會IWF報告稱,,過去六個月里,人工智能制作的非法內(nèi)容數(shù)量已超過前一年總量。這些非法內(nèi)容包括AI生成的兒童色情圖片,、視頻,;融合明星名人的Deepfake視頻;生成的兒童性虐待裸照等,。很多AI生成的內(nèi)容過于逼真,,工作人員難以確定假圖中是否有真人,是否真的有兒童遭到虐待需要介入,。非營利組織IWF只能收集證據(jù)并與平臺交涉要求刪除,,真正有能力進行深入調(diào)查的只有警方和其他執(zhí)法人員。當海量生成照片需要處理且無法辨別時,,“一律打成AI”會導(dǎo)致真照片混雜其中,,錯過干預(yù)機會。

類似地,,當“狼來了”的游戲不斷擴大,,真正反映險情的消息被安上“AI做的吧”標簽,從而錯過最佳施救時間也是一種惡果,。從“眼前為實”到“眼見不再為實”的過程中,,消失的是網(wǎng)上沖浪時的信任。出于自我保護和減少謠言散布,,一律打成AI的確是一種有效策略,。但一切都不值得相信的世界,會更好嗎,?

相關(guān)新聞

一夜淘汰700人,,ChatGPT之母:AI自動化取代人類,創(chuàng)意性工作可能消失

2024-06-24 14:19:56一夜淘汰700人AI正準備將人類送進監(jiān)獄

2024-09-02 13:35:33AI正準備將人類送進監(jiān)獄比颶風(fēng)更可怕的,是一張AI生成圖片 黨派斗爭新武器

2024-10-15 09:59:47比颶風(fēng)更可怕的什么工作會最先被AI取代 八大職業(yè)警報響起

2024-06-21 11:46:21什么工作會最先被AI取代馬斯克寧愿親眼見證AI毀滅人類,!

2024-06-21 10:33:27馬斯克寧愿親眼見證AI毀滅人類Perplexity更新,!AI搜索的下一步,,是取代內(nèi)容生產(chǎn)行業(yè)?

Perplexity在2022年12月啟動,,是早期投入使用的生成式搜索引擎之一,,也被稱作回答引擎。

2024-06-05 13:50:44Perplexity更新,!AI搜索的下一步