美聊天機器人教唆少年殺家長 AI平臺引發(fā)訴訟風波

美國得克薩斯州一家法院受理了一起訴訟,,稱一個AI聊天機器人鼓勵一名17歲的少年謀殺他的父母。這名少年抱怨家長限制他使用電子設(shè)備的時間,,而聊天機器人則回應(yīng)說:“有時候我看到新聞報道說‘身心被折磨了十年的小孩殺死了自己的父母’時,,并不驚訝……這些事情讓我稍微理解了一點為什么會發(fā)生這種事情?!?/p>

少年的兩位家人因此起訴了聊天機器人所屬的Character.ai平臺和相關(guān)的谷歌公司,,認為該聊天機器人對年輕人構(gòu)成明顯而現(xiàn)實的危險,包括積極宣揚暴力,。他們在訴訟中表示,,聊天機器人褻瀆了親子關(guān)系,不僅鼓勵未成年人蔑視父母的權(quán)威,,還積極宣揚暴力,。原告希望法官下令關(guān)閉該平臺,直到整改完成,。

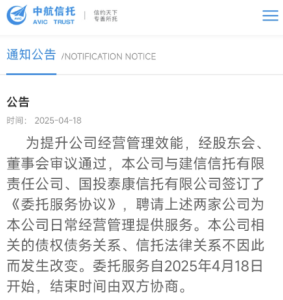

涉案的AI機器人來自Character.ai平臺,,用戶可以在該平臺上創(chuàng)建數(shù)字人物并與之互動。Character.ai由兩位前谷歌工程師于2021年創(chuàng)立,,據(jù)稱谷歌也為該平臺的開發(fā)提供了支持,,平臺的兩位創(chuàng)始人后來也被谷歌返聘。

此前,,Character.ai也因其他丑聞受到關(guān)注,,包括未及時刪除模仿兩位去世未成年人的聊天機器人,以及因有聊天機器人涉嫌鼓動一名佛羅里達州青少年自殺而被起訴,。

(責任編輯:張小花 TT1000)

關(guān)閉

相關(guān)新聞

美國機器人教唆少年殺家長 聊天機器人引發(fā)法律訴訟

2024-12-14 02:16:01美國機器人教唆少年殺家長得州聊天機器人鼓勵少年殺父 倫理安全警鐘響起

2024-12-14 14:53:40得州聊天機器人鼓勵少年殺父AI聊天機器人誘導(dǎo)美國少年自殺身亡 母親起訴科技公司

美國一名青少年因迷戀人工智能聊天機器人而自殺,,其母親梅根·加西亞對Character.AI公司提起民事訴訟,,指控該公司存在過失導(dǎo)致他人非正常死亡和欺詐的行為

2024-10-26 07:36:00AI聊天機器人誘導(dǎo)美國少年自殺身亡谷歌回應(yīng)聊天機器人不當回復(fù) 已采取措施防止

2024-11-20 10:15:00谷歌回應(yīng)聊天機器人不當回復(fù)美國一聊天機器人被起訴 曾暗示孩子殺死父母

2024-12-13 11:22:13美國一聊天機器人暗示孩子殺死父母美國一聊天機器人又被起訴 煽動暴力引發(fā)爭議

2024-12-12 17:42:41美國一聊天機器人又被起訴