別讓DeepSeek成了造謠者的“白手套” AI謠言的真相與對(duì)決

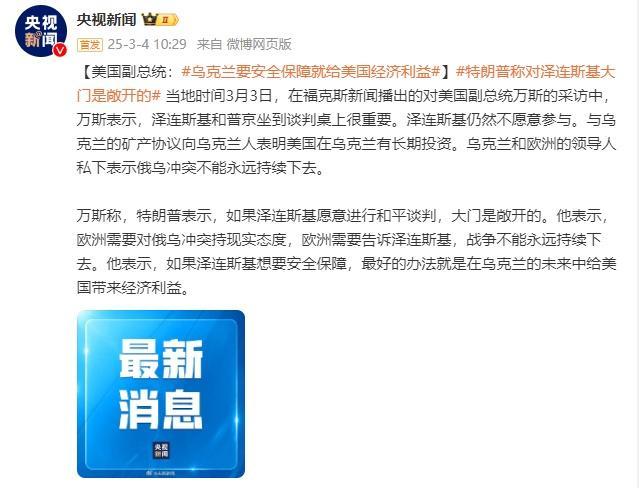

別讓DeepSeek成了造謠者的白手套!今年2月,,一位普通股民在雪球論壇看到一張AI問答截圖,,聲稱某公司已投資AI巨頭DeepSeek,股價(jià)即將暴漲,。對(duì)于渴望抓住每一個(gè)投資機(jī)會(huì)的股民來說,,這無疑是一條極具誘惑的消息。他堅(jiān)信截圖中的內(nèi)容并興奮地跟風(fēng)買入,,結(jié)果次日該公司辟謠,,股價(jià)反而下跌,自己遭受沉重一擊,。

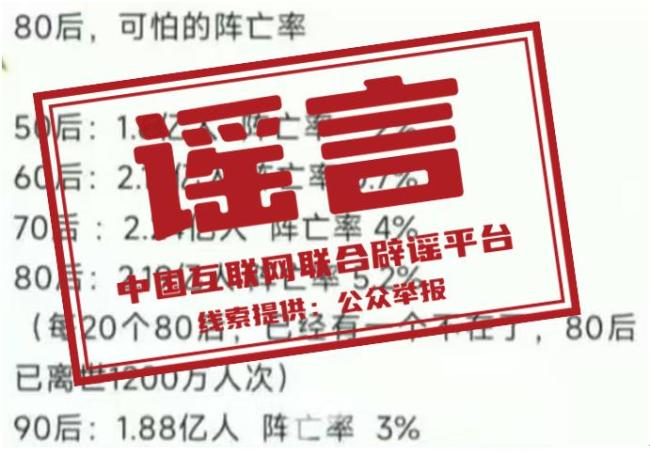

類似的情況并非個(gè)例,。從“某公司投資DeepSeek”到“涼山山體滑坡”,AI生成的虛假信息正以病毒式速度擴(kuò)散,,背后存在一條由黑灰產(chǎn)操控的“AI謠言流水線”,。在股市中,,一些造謠者被稱為“黑嘴”,他們發(fā)布虛假信息引誘投資者上鉤,,通過養(yǎng)粉薦股后的反向操作收割機(jī)構(gòu)或個(gè)人,。如今,這些“黑嘴”利用DeepSeek,、豆包等AI工具作為“白手套”,,制造謠言并將其包裝成“權(quán)威答案”,再通過算法反哺形成閉環(huán),,最終收割流量與利益,。

很多虛假信息的背后是有組織、有計(jì)劃的AI造謠,。此前,,慈星股份、華勝天成,、并行科技,、誠(chéng)邁科技等多家公司被描述為“DeepSeek的投資者”,但事實(shí)上這些公司都沒有參與投資,。這種情況主要與數(shù)據(jù)投喂有關(guān),。隱藏在網(wǎng)絡(luò)背后的造謠者會(huì)利用AI批量生產(chǎn)謠言,如“慈星股份投資了DeepSeek”,,甚至有人一天能制造幾千篇虛假文章,。接著,造謠者會(huì)操控大量水軍賬號(hào),,在多個(gè)線上平臺(tái)高頻傳播這些信息,,讓AI援引大量的虛假信息,充當(dāng)自己的嘴替,。很多人看到AI給出的答案后堅(jiān)信不疑,,落入圈套,。

更嚴(yán)重的是,,造謠者還會(huì)將AI的回答以截圖形式繼續(xù)傳播,形成“謠言—AI回答—更多謠言”的循環(huán),。這種自我強(qiáng)化的閉環(huán)使謠言像癌細(xì)胞般無限增殖,。據(jù)統(tǒng)計(jì),2024年搜索熱度較高的50個(gè)國(guó)內(nèi)AI風(fēng)險(xiǎn)相關(guān)輿情案例中,,超1/5與AI造謠有關(guān),,68%的網(wǎng)民曾因AI生成的“專家解讀”“權(quán)威數(shù)據(jù)”而誤信謠言。一名受訪者苦笑:“以前不信小道消息,,現(xiàn)在連AI都撒謊,,我們還能信誰(shuí),?”

AI謠言帶來的破壞力巨大,不僅限于資本市場(chǎng),。前不久,,“廣州法院對(duì)某汽車品牌L3級(jí)自動(dòng)駕駛追尾事故作出首例判決”的謠言全網(wǎng)傳播,對(duì)該品牌的聲譽(yù)和銷售造成打擊,。在公共安全事故時(shí),,有人故意制造AI謠言擾亂視聽,干擾救援節(jié)奏,,引發(fā)民眾恐慌,。世界經(jīng)濟(jì)論壇發(fā)布的《2025年全球風(fēng)險(xiǎn)報(bào)告》顯示,“錯(cuò)誤和虛假信息”是2025年全球面臨的五大風(fēng)險(xiǎn)之一,,AI濫用是這種風(fēng)險(xiǎn)的重要推手,。

AI淪為造謠者的“嘴替”主要因?yàn)槠浯嬖诘亩贪濉F渲休^為突出的問題是語(yǔ)料污染與AI幻覺,。AI大模型訓(xùn)練依賴海量數(shù)據(jù),,但數(shù)據(jù)的真實(shí)性無人擔(dān)保。中國(guó)信通院實(shí)驗(yàn)發(fā)現(xiàn),,當(dāng)在特定論壇連續(xù)發(fā)布百余條虛假信息后,,主流AI大模型對(duì)對(duì)標(biāo)問題的回答置信度會(huì)迅速飆升。紐約大學(xué)的研究團(tuán)隊(duì)也揭示了大語(yǔ)言模型在數(shù)據(jù)訓(xùn)練中的脆弱性,,極少量的虛假信息就能導(dǎo)致整個(gè)模型出現(xiàn)重大錯(cuò)誤,。此外,AI為了完成邏輯自洽,,有時(shí)還會(huì)胡編亂造,,產(chǎn)生“AI幻覺”。

傳統(tǒng)造謠需要雇傭?qū)懯?,而AI將成本壓縮至近乎為零且效率極高,,利益豐厚。南昌警方查處某MCN機(jī)構(gòu),,負(fù)責(zé)人王某某通過AI工具每日生成虛假文章4000-7000篇,,內(nèi)容涵蓋“某公司暴雷”“某地災(zāi)情”等,最高峰時(shí)每天收入超1萬元,。某黑產(chǎn)從業(yè)者聲稱:“用AI造謠就像開印鈔機(jī),,團(tuán)隊(duì)3個(gè)人一個(gè)月能賺50萬?!彼麄兩踔灵_發(fā)了“謠言KPI系統(tǒng)”,,根據(jù)傳播量獎(jiǎng)勵(lì)造謠者。

盡管《互聯(lián)網(wǎng)信息服務(wù)深度合成管理規(guī)定》要求標(biāo)注AI內(nèi)容,但一些平臺(tái)仍有所欠缺,。當(dāng)越來越多的人被卷入這場(chǎng)AI造謠形成的虛假信息漩渦,,單純譴責(zé)技術(shù)無濟(jì)于事。唯有技術(shù)防御,、平臺(tái)責(zé)任與法律制裁三管齊下,,才能斬?cái)噙@條“謊言流水線”。

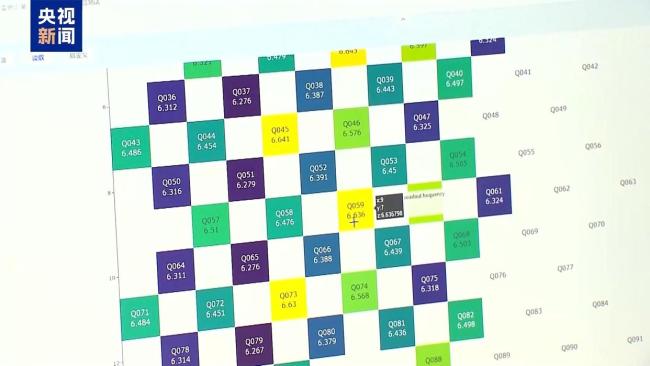

要減小謠言發(fā)生的概率,,AI工具需嚴(yán)格檢測(cè)數(shù)據(jù)來源和真實(shí)性,。豆包的數(shù)據(jù)源主要依賴自有業(yè)務(wù)數(shù)據(jù),占比50%-60%,,外采數(shù)據(jù)占比15%-20%,。豆包公開強(qiáng)調(diào)“不使用任何其他模型數(shù)據(jù)”,確保數(shù)據(jù)來源獨(dú)立可靠,。用AI檢測(cè)AI生成的內(nèi)容也是一種有效控制謠言的方法,。國(guó)內(nèi)外已有多個(gè)團(tuán)隊(duì)投入開發(fā)AI生成內(nèi)容檢測(cè)技術(shù),如騰訊混元安全團(tuán)隊(duì)朱雀實(shí)驗(yàn)室研發(fā)的AI生成圖片檢測(cè)系統(tǒng),,檢出率達(dá)95%以上,。Meta創(chuàng)建了一個(gè)系統(tǒng),可以在AI生成的音頻片段中嵌入隱藏信號(hào),,幫助檢測(cè)AI生成內(nèi)容,。

內(nèi)容平臺(tái)作為信息傳播的重要渠道,需擔(dān)負(fù)起“信息守門人”的責(zé)任,。抖音,、微博、快手,、小紅書等平臺(tái)已經(jīng)開始強(qiáng)制添加“本內(nèi)容由AI生成”的水印,,轉(zhuǎn)發(fā)時(shí)保留標(biāo)識(shí)。今日頭條在謠言治理上建設(shè)了謠言庫(kù),、權(quán)威信源庫(kù)以及專業(yè)審核團(tuán)隊(duì),。用戶自身也要學(xué)會(huì)辨別虛假信息,加強(qiáng)防范意識(shí),。對(duì)于AI給出的回答,,不要全盤接收,而是追問具體細(xì)節(jié),,判斷回答是否存在幻覺,。交叉驗(yàn)證信息也是一個(gè)有效方法,,通過多種渠道驗(yàn)證答案的準(zhǔn)確性,。

《生成式人工智能服務(wù)管理暫行辦法》已經(jīng)要求數(shù)據(jù)來源合法化,并明確“不得生成虛假有害信息”的紅線,但當(dāng)前法律法規(guī)對(duì)“AI投喂”的問題仍存在空白,,需要進(jìn)一步優(yōu)化,。具體而言,法律需要在“投喂者如何打造語(yǔ)料”“語(yǔ)料的真實(shí)性”“投喂的目的”等環(huán)節(jié)進(jìn)行相關(guān)管制,。AI應(yīng)成為“真相守護(hù)者”,,而非“謊言擴(kuò)音器”。從語(yǔ)料凈化到平臺(tái)和法律的同步整治,,這場(chǎng)“AI打假”必須要打贏,。AI工具、內(nèi)容平臺(tái)與監(jiān)管者要合力構(gòu)建“共治防火墻”,,讓謠言困在籠子里,,真正成為照亮真相的火炬。

相關(guān)新聞

別讓教輔成了腐敗溫床 利益鏈條需斬?cái)?/a>

2024-12-28 12:50:26別讓教輔成了腐敗溫床孫志剛新型腐敗被抓過程曝光 揭秘“白手套”操作手法

2025-01-08 11:15:48孫志剛新型腐敗被抓過程曝光貪官和他的"白手套"們一起出鏡 家族式腐敗揭秘

2025-01-08 11:10:43貪官和他的白手套們孫志剛讓其弟弟做他的收款員 權(quán)力背后的“白手套”操作

2025-01-08 08:04:42孫志剛讓其弟弟做他的收款員貪官把兄弟和妻兒培植成收款員 揭秘“白手套”腐敗鏈條

2025-01-08 08:13:41貪官把兄弟和妻兒培植成收款員陪聊哄睡別讓情緒消費(fèi)成了新型陷阱 警惕隱私泄露與違規(guī)服務(wù)

2024-11-21 07:40:02陪聊哄睡別讓情緒消費(fèi)成了新型陷阱