DeepSeek公布推理新論文 提升獎(jiǎng)勵(lì)模型可擴(kuò)展性(2)

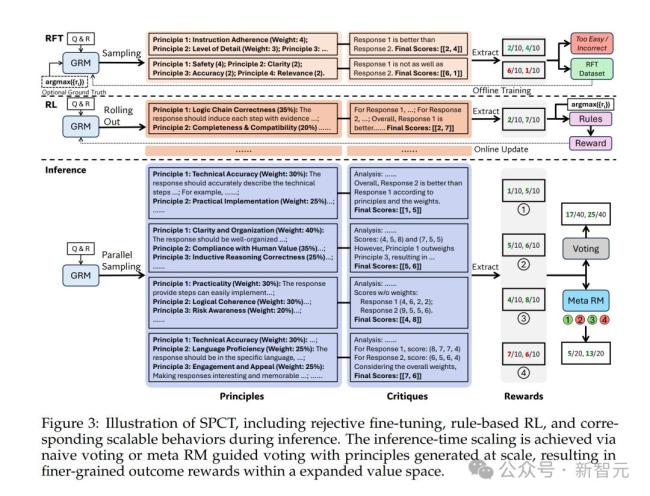

研究者的貢獻(xiàn)包括:提出了一種新方法——自我原則點(diǎn)評(píng)調(diào)優(yōu)(SPCT),用于推動(dòng)通用獎(jiǎng)勵(lì)建模在推理階段實(shí)現(xiàn)有效的可擴(kuò)展性,;SPCT顯著提升了GRM在獎(jiǎng)勵(lì)質(zhì)量和推理擴(kuò)展性能方面的表現(xiàn),,超過(guò)了現(xiàn)有方法及多個(gè)強(qiáng)勁的公開模型,;將SPCT的訓(xùn)練流程應(yīng)用于更大規(guī)模的LLM,,并發(fā)現(xiàn)相比于訓(xùn)練階段擴(kuò)大模型參數(shù)量,推理階段的擴(kuò)展策略在性能上更具優(yōu)勢(shì),。

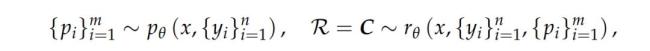

SPCT方法包括兩個(gè)階段:拒絕式微調(diào)作為冷啟動(dòng)階段,,以及基于規(guī)則的在線強(qiáng)化學(xué)習(xí)。拒絕式微調(diào)的核心思想是讓GRM適應(yīng)不同輸入類型,,并以正確的格式生成原則與點(diǎn)評(píng)內(nèi)容,。基于規(guī)則的在線強(qiáng)化學(xué)習(xí)則進(jìn)一步微調(diào)GRM,,通過(guò)提升生成的原則和點(diǎn)評(píng)內(nèi)容來(lái)強(qiáng)化通用獎(jiǎng)勵(lì)的生成過(guò)程,。

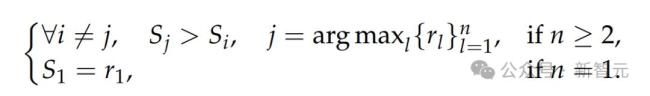

為了提升DeepSeek-GRM在生成通用獎(jiǎng)勵(lì)上的性能,研究團(tuán)隊(duì)探索了如何利用更多的推理計(jì)算,,通過(guò)基于采樣的策略來(lái)實(shí)現(xiàn)有效的推理時(shí)擴(kuò)展,。逐點(diǎn)GRM投票過(guò)程被定義為將獎(jiǎng)勵(lì)求和,這實(shí)際上將獎(jiǎng)勵(lì)空間擴(kuò)大了k倍,,使GRM能生成大量原則,,從而提升最終獎(jiǎng)勵(lì)的質(zhì)量和細(xì)膩度。為了避免位置偏差并增加多樣性,,研究人員在采樣前會(huì)對(duì)回答進(jìn)行隨機(jī)打亂,。

相關(guān)新聞

DeepSeek發(fā)布新論文 梁文鋒是共創(chuàng) NSA機(jī)制革新長(zhǎng)文本處理

2025-02-18 20:31:32DeepSeek發(fā)布新論文梁文鋒是共創(chuàng)英偉達(dá)創(chuàng)滿血DeepSeek推理世界紀(jì)錄 性能顯著提升

英偉達(dá)在NVIDIA GTC 2025上宣布,,其NVIDIA Blackwell DGX系統(tǒng)創(chuàng)下DeepSeek-R1大模型推理性能的世界紀(jì)錄

2025-03-20 09:03:59英偉達(dá)創(chuàng)滿血DeepSeek推理世界紀(jì)錄DeepSeek崛起對(duì)AI芯片行業(yè)有何影響 推動(dòng)推理芯片需求增長(zhǎng)

2025-02-08 09:31:04DeepSeek崛起對(duì)AI芯片行業(yè)有何影響DeepSeek利好哪些AI基建產(chǎn)業(yè)鏈環(huán)節(jié) 推理需求增長(zhǎng)帶動(dòng)新機(jī)遇

DeepSeek震動(dòng)硅谷,其高性價(jià)比的訓(xùn)練技術(shù)引發(fā)了市場(chǎng)的廣泛關(guān)注

2025-02-02 11:44:50DeepSeek利好哪些AI基建產(chǎn)業(yè)鏈環(huán)節(jié)黃仁勛揭秘下一代芯片Rubin,,英偉達(dá)想要吃“DeepSeek紅利” 推理時(shí)代的新機(jī)遇

2025-03-19 12:03:54黃仁勛揭秘下一代芯片RubinDeepSeek評(píng)價(jià)Manus AI新黑馬崛起

2025-03-07 12:11:05DeepSeek評(píng)價(jià)Manus