DeepSeek公布推理新論文 提升獎(jiǎng)勵(lì)模型可擴(kuò)展性(4)

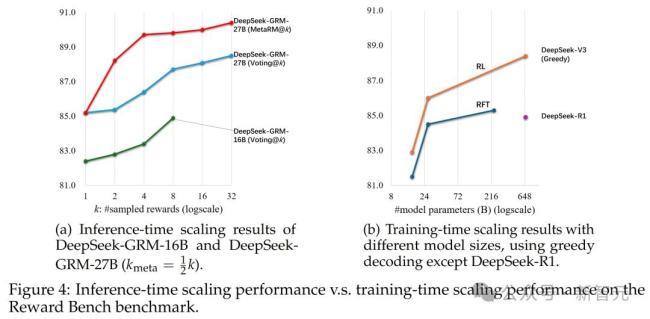

研究團(tuán)隊(duì)進(jìn)一步研究了DeepSeek-GRM-27B在不同規(guī)模LLM后訓(xùn)練下的推理時(shí)和訓(xùn)練時(shí)擴(kuò)展性能。使用32個(gè)樣本直接投票的DeepSeek-GRM-27B可以達(dá)到與671B MoE模型相當(dāng)?shù)男阅?,而meta RM指導(dǎo)的投票僅用8個(gè)樣本就能取得最佳結(jié)果,,證明了DeepSeek-GRM-27B在推理時(shí)擴(kuò)展上的有效性,優(yōu)于單純擴(kuò)大模型規(guī)模,。

(責(zé)任編輯:張蕾)

關(guān)閉

相關(guān)新聞

DeepSeek發(fā)布新論文 梁文鋒是共創(chuàng) NSA機(jī)制革新長文本處理

2025-02-18 20:31:32DeepSeek發(fā)布新論文梁文鋒是共創(chuàng)英偉達(dá)創(chuàng)滿血DeepSeek推理世界紀(jì)錄 性能顯著提升

英偉達(dá)在NVIDIA GTC 2025上宣布,其NVIDIA Blackwell DGX系統(tǒng)創(chuàng)下DeepSeek-R1大模型推理性能的世界紀(jì)錄

2025-03-20 09:03:59英偉達(dá)創(chuàng)滿血DeepSeek推理世界紀(jì)錄DeepSeek崛起對(duì)AI芯片行業(yè)有何影響 推動(dòng)推理芯片需求增長

2025-02-08 09:31:04DeepSeek崛起對(duì)AI芯片行業(yè)有何影響DeepSeek利好哪些AI基建產(chǎn)業(yè)鏈環(huán)節(jié) 推理需求增長帶動(dòng)新機(jī)遇

DeepSeek震動(dòng)硅谷,,其高性價(jià)比的訓(xùn)練技術(shù)引發(fā)了市場的廣泛關(guān)注

2025-02-02 11:44:50DeepSeek利好哪些AI基建產(chǎn)業(yè)鏈環(huán)節(jié)黃仁勛揭秘下一代芯片Rubin,英偉達(dá)想要吃“DeepSeek紅利” 推理時(shí)代的新機(jī)遇

2025-03-19 12:03:54黃仁勛揭秘下一代芯片RubinDeepSeek評(píng)價(jià)Manus AI新黑馬崛起

2025-03-07 12:11:05DeepSeek評(píng)價(jià)Manus